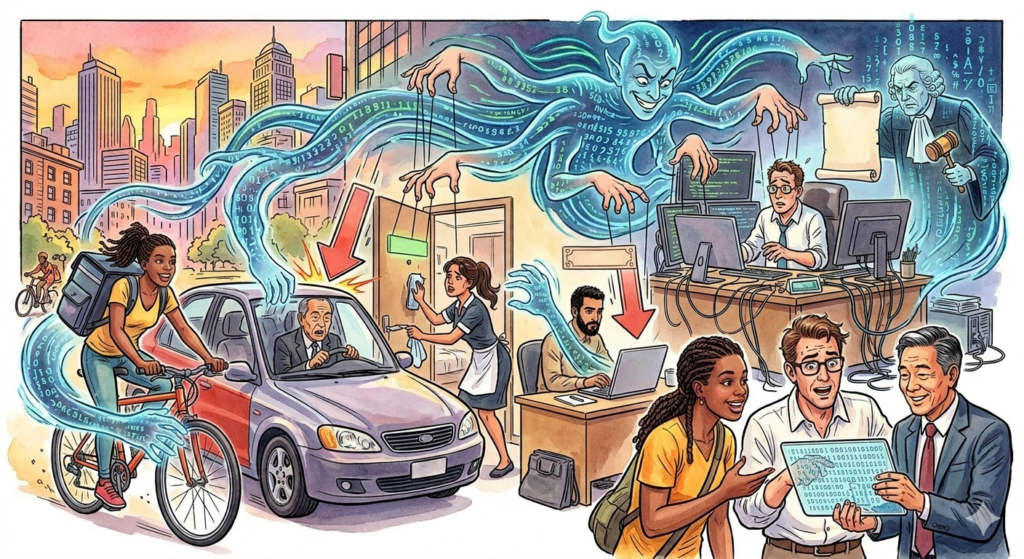

Les plateformes d’aujourd’hui ne managent plus seulement par des consignes humaines ; elles managent par des lignes de code. Un algorithme décide qui voit quelles missions, qui est mis en avant, qui est peu à peu invisibilisé, qui est coupé du flux. Une note moyenne qui descend, un taux de refus jugé trop élevé, un “score” opacifié… et la réalité économique des travailleurs bascule.

Pour un entrepreneur qui veut « ubériser » une activité, le danger est clair : plus ton algorithme ressemble à un manager, plus le juge risque de te qualifier d’employeur. Dans l’article 1, on a vu comment les ordres, le contrôle et les sanctions forment le triptyque de la subordination. Ici, on va voir comment un algorithme mal conçu peut remplir ce rôle de manager invisible — et comment, au contraire, le concevoir comme un outil neutre, compatible avec de vrais indépendants.

L’objectif de cet article est double :

- t’expliquer où se situent les lignes rouges juridiques autour des algorithmes (notation, géolocalisation, score),

- te donner des solutions concrètes pour concevoir, négocier et ajuster ton système de manière compatible avec l’indépendance réelle, en intégrant la négociation raisonnée et les modes amiables à ton architecture décisionnelle.

I. Quand l’algorithme devient un manager : comprendre ce qui fait basculer dans le salariat

1. Du simple outil de matching à un véritable pouvoir de direction

Au départ, l’algorithme est un outil : il sert à affecter une mission à un prestataire, à calculer une distance, à afficher une note. Mais la jurisprudence montre que, dès que cet outil prend des décisions qui affectent concrètement la liberté du travailleur, on commence à parler de pouvoir de direction algorithmique.

Les fichiers que tu as fournis insistent sur plusieurs signaux d’alerte :

- un algorithme qui impose un itinéraire et corrige la rémunération si l’itinéraire n’est pas suivi (affaire Uber) ;

- un système de “strikes” et de déconnexion automatique en cas de refus répétés de missions (affaire Take Eat Easy) ;

- un score qui conditionne l’accès aux meilleures missions, sans possibilité de contestation, et qui finit par exclure de fait les “mauvais classés”.

Dans ces cas, l’algorithme ne se contente pas de trier des informations. Il fait ce qu’un manager ferait dans une entreprise classique : dire quoi faire, vérifier et sanctionner. C’est précisément ce que le droit du travail appelle subordination juridique.

Exemple : livraison de repas “gamifiée”

Une plateforme de livraison met en place un système de niveaux, badges, bonus. En apparence, c’est du “fun”. Mais, dans les faits :

- seuls les livreurs de niveau 3 ou 4 peuvent accéder aux meilleurs créneaux horaires,

- pour monter de niveau, il faut accepter 95 % des courses,

- deux semaines à 90 % et le livreur redescend de niveau, perdant une partie de ses revenus.

Le juge pourra considérer que cette gamification constitue un outil de pression économique comparable à des sanctions disciplinaires.

2. Les indices de contrôle algorithmique déjà sanctionnés par les juges

Les décisions Uber et Take Eat Easy illustrent la façon dont les juges lisent les algorithmes.

Ils retiennent notamment :

- L’itinéraire imposé : quand l’application impose une route, corrige le prix et reproche au chauffeur une “mauvaise route”, on est proche d’un ordre hiérarchique.

- La gémolocalisation en continu : utilisée non pas seulement pour informer le client, mais pour suivre le temps de travail, les pauses, les refus, et alimenter un système de sanctions.

- Le système de notation disciplinaire : une mauvaise note entraîne automatiquement une baisse de priorité, puis une exclusion. Ce mécanisme de “note‑sanction” est considéré comme un pouvoir disciplinaire.

Autrement dit, si ton back‑office ressemble à un tableau de bord RH (taux d’acceptation, de présence, de refus, de “performance”), si ton algorithme enchaîne décisions et sanctions quasi automatiques, tu fournis au juge exactement le faisceau d’indices nécessaire pour requalifier.

Exemple : micro‑tâches payées à la pièce

Une plateforme propose des micro‑tâches (photos de linéaires, questions simples) :

- si un “micro‑travailleur” refuse trop de tâches, son compte est automatiquement suspendu,

- son taux de réponse est mesuré en continu,

- un système opaque de score détermine l’ordre dans lequel les tâches lui sont proposées.

Même si chaque mission est très courte, l’ensemble du dispositif peut être vu comme un contrôle permanent de l’activité, donc un indice de subordination.

3. Les nouvelles couches de contraintes : RGPD, DSA et futur cadre européen des plateformes

À côté du droit du travail, tu subis maintenant deux autres pressions majeures :

- le RGPD, qui encadre l’usage des données personnelles (géolocalisation, profilage, scoring) ;

- le Digital Services Act (DSA), qui impose de la transparence sur les systèmes de recommandation, la modération, les risques systémiques.

Les documents mentionnent aussi la directive européenne sur les travailleurs de plateformes, qui va instaurer une présomption de salariat dans certains cas, à renverser par la preuve d’une véritable indépendance.

Concrètement, cela veut dire que :

- plus ton algorithme a d’impact sur l’accès aux revenus des travailleurs, plus il sera scrutiné par les juges, les autorités de contrôle et les syndicats ;

- tu seras de plus en plus amené à expliquer comment il fonctionne, à documenter ses critères, à accepter des formes de dialogue voire de négociation sur l’algorithme lui‑même.

D’où l’importance de ne pas concevoir ton algorithme seul dans un coin avec ton équipe data, mais de l’inscrire dès le départ dans une logique de gouvernance partagée et de négociation raisonnée.

II. Concevoir un algorithme compatible avec de vrais indépendants

L’enjeu n’est pas de renoncer aux algorithmes, mais de les concevoir comme des outils de service, pas comme des outils de commandement.

1. Un système de matching qui laisse une vraie liberté de choix

Le cœur de la relation plateforme/travailleur, c’est la proposition de mission. C’est là que se joue une bonne partie de l’indépendance :

- l’indépendant doit pouvoir refuser sans sanction,

- il doit pouvoir choisir ses créneaux, sa zone, son type de missions.

Bonnes pratiques de design :

- Proposer des missions en libre‑service, sans obligation de volume : les prestataires voient les missions disponibles dans une zone et choisissent celles qu’ils veulent, sans impact négatif s’ils n’en prennent aucune.

- Ne pas organiser le back‑office autour d’un “taux d’acceptation” ou d’un “objectif de missions par heure”. Ce genre d’indicateurs ressemble à un pilotage salarié.

- Éviter les délais de réponse ultra courts qui mettent une pression artificielle (par exemple 5 secondes pour accepter une course) ; les textes récents sur les plateformes de mobilité insistent sur l’obligation de prévoir des délais raisonnables.

Exemple : plateforme de freelances B2B

Pour une marketplace de développeurs, graphistes, consultants :

- les missions sont publiées avec un budget, une durée, une description ;

- les freelances candidatent librement, avec leur TJM et leurs conditions ;

- l’algorithme classe les candidatures, mais ne sanctionne jamais ceux qui ne répondent pas.

Ici, l’algorithme sert à trier des offres, pas à imposer du travail. On est dans une logique de marché, pas dans une logique salariale.

2. Notation et réputation : comment éviter de transformer la note en arme disciplinaire

La réputation en ligne est devenue l’outil central de la confiance : les clients veulent des notes, des avis, des commentaires. Mais la note est aussi une arme redoutable : si une mauvaise note ferme la porte à toute mission, elle devient une sanction déguisée.

Pour rester du côté “réputation”, et non du côté “discipline” :

- La note ne doit pas être le seul critère de matching. Intègre aussi la localisation, l’ancienneté, la disponibilité, mais sans que la note moyenne basse aboutisse automatiquement à un bannissement.

- Prévois un droit de réponse : le prestataire peut expliquer sa version, contester un avis manifestement de mauvaise foi.

- Crée un processus humain de revue des cas extrêmes : si un prestataire tombe sous un certain seuil, il doit y avoir une analyse, un échange, une possibilité de médiation avant toute décision.

C’est ici que la négociation raisonnée est précieuse :

- tu peux expliquer les critères de notation (délais, qualité perçue, politesse, etc.) comme des critères objectifs,

- tu peux co‑construire avec des représentants de prestataires les seuils, les pondérations, les conséquences possibles.

Au lieu d’un algorithme qui juge seul et sanctionne, tu as un système où les règles du jeu sont discutées, explicites, évaluées.

3. Géolocalisation et données de performance : limiter, anonymiser, documenter

La géolocalisation et les données de performance (nombre de missions, temps de réponse, temps de trajet) sont très sensibles. Elles peuvent être utiles… ou devenir un flic numérique.

Bonnes pratiques RGPD et sociales :

- Limiter la géolocalisation au temps de mission. En dehors de la mission, le prestataire doit pouvoir être invisible pour la plateforme.

- Anonymiser ou agréger les historiques pour tout ce qui concerne les statistiques globales ; ne garder les traces individuelles que le temps strictement nécessaire pour la facturation, la preuve, la sécurité.

- Ne jamais utiliser ces données pour “optimiser” des sanctions : par exemple, ne pas réduire la visibilité d’un prestataire parce qu’il s’éloigne d’une zone “densément profitable”.

Là encore, la documentation est essentielle :

- registre des traitements, analyses d’impact (DPIA) si profilage à grande échelle,

- politique écrite expliquant ce qui est fait avec les données des prestataires,

- transparence sur les finalités, les durées de conservation, les destinataires.

Plus tu es transparent et raisonnable sur les données, plus il devient crédible d’affirmer que ton algorithme organise un marché, pas une main‑d’œuvre.

III. Gouverner, négocier et ajuster l’algorithme : la clé pour éviter l’escalade contentieuse

Même avec un algorithme bien conçu, tu restes exposé :

- les travailleurs de plateformes s’organisent,

- les autorités renforcent les contrôles,

- la jurisprudence évolue.

Tu ne peux plus te permettre de gérer l’algorithme “en solo”. Il faut le gouverner, le négocier et le mettre en débat.

1. Créer une transparence algorithmique négociée

Les textes récents sur les plateformes de mobilité (VTC, livraison) et le DSA convergent : les plateformes doivent être plus transparents sur le fonctionnement de leurs systèmes de recommandation et de distribution des missions.

Pour un entrepreneur, cette transparence peut faire peur (“on va dévoiler notre secret sauce”). En réalité, tu n’as pas besoin de publier ton code source, mais tu dois :

- expliquer les critères utilisés (note, ancienneté, proximité, temps de connexion, etc.) ;

- indiquer leur rôle relatif (par exemple, “la localisation compte plus que la note”) ;

- informer les prestataires des changements majeurs (changement de pondération, introduction d’un nouveau score).

C’est là que tu peux institutionnaliser la négociation raisonnée :

- en créant un “conseil des prestataires” ou en t’inscrivant dans les instances de représentation existantes ;

- en présentant les données (revenus moyens, répartition des missions) comme des critères objectifs de discussion ;

- en explorant ensemble des scénarios de réglage de l’algorithme pour améliorer à la fois la qualité de service et le revenu des prestataires.

Tu passes d’une logique descendante (“l’algorithme a parlé”) à une logique collaborative, où l’algorithme devient un objet de négociation, avec des BATNA clairement identifiées :

- pour toi : le risque de requalification, de grèves, de “bad buzz” ;

- pour eux : le risque de revenus trop faibles, de déconnexion, de précarité.

2. Intégrer des modes amiables face aux décisions automatisées

Un point critique pour les juges, les syndicats et les autorités, ce sont les décisions automatiques :

- fermeture de compte,

- baisse brutale de visibilité,

- exclusion de certaines catégories de missions.

Le RGPD encadre déjà la prise de décision automatisée (article 22), et les textes sectoriels mettent en avant l’idée qu’il doit toujours exister une possibilité de recours humain.

Concrètement, tu peux mettre en place :

- une procédure de médiation interne pour les prestataires qui contestent une décision de l’algorithme ;

- un formulaire simple pour demander la revue humaine d’une situation (note injuste, déconnexion jugée abusive, baisse de visibilité non comprise) ;

- des délais et des engagements de réponse clairs, pour éviter la frustration et l’escalade.

Ces modes amiables — médiation, conciliation interne, revue par un “ombudsman” — jouent un double rôle :

- ils réduisent les tensions, en offrant un espace de dialogue structuré ;

- ils démontrent, en cas de contentieux, que tu ne gères pas ta “main‑d’œuvre” par des décisions automatisées arbitraires, mais que tu acceptes la discussion, la correction, le compromis.

3. Prévoir des scénarios de pivot : quand l’algorithme montre que le modèle n’est plus tenable

Enfin, il faut être lucide : parfois, malgré tous les efforts de design, la réalité économique pousse vers un modèle qui ressemble de plus en plus à du salariat.

Quelques signaux d’alerte :

- tu as besoin de contrôler très précisément les horaires et la disponibilité ;

- la qualité de service exige des procédures uniformes, des scripts, des itinéraires imposés ;

- une partie significative de tes “indépendants” travaille quasi exclusivement pour toi, à temps plein.

Dans ce cas, la négociation raisonnée doit servir à explorer des alternatives :

- salariat direct pour un noyau dur de prestataires,

- recours au portage salarial pour les profils experts,

- création ou partenariat avec une coopérative d’activité et d’emploi (CAE), où les travailleurs deviennent des entrepreneurs‑salariés.

L’algorithme te fournit alors une donnée clé : la réalité du travail (temps de connexion, récurrence, exclusivité). Ce sont exactement ces éléments qui, mis sur la table, peuvent nourrir une négociation collective sur le choix du modèle le plus soutenable — plutôt que d’attendre une requalification imposée par un juge.

Ton algorithme est un formidable levier de création de valeur…

ou un formidable générateur de risques. En organisant qui travaille, quand, comment, contre quelle rémunération, il peut très vite être assimilé à un manager numérique, avec toutes les conséquences du droit du travail classique.

Pour éviter cela, tu dois le concevoir :

- comme un outil de mise en relation, pas de commandement ;

- comme un système de réputation et de données transparent, pas un système de sanctions automatiques ;

- comme un objet de négociation raisonnée et de dialogue, appuyé par des modes amiables, pas comme une boîte noire imposée unilatéralement.

C’est cette transformation du “manager algorithmique” en outil partagé, discuté, ajusté qui te permettra de rester du côté de la vraie indépendance, tout en construisant une plateforme juridiquement solide et socialement défendable.

Mantra

« La négociation est un sport de combat – Il faut savoir être dur avec les questions à traiter tout en préservant les relations. »

Contact

Une question ? Parlons-en, tout simplement.

Prise de rendez-vous via la page d’accueil ou par courriel : martin@lacour-avocat.fr

FAQ

- C’est quoi un “employeur algorithmique” ?

On parle d’employeur algorithmique quand une plateforme utilise un algorithme pour donner des ordres, contrôler le travail et sanctionner les prestataires, comme le ferait un manager dans une entreprise classique. - En quoi mon algorithme peut me faire requalifier en employeur ?

S’il impose des itinéraires, contrôle la présence et les refus et déconnecte automatiquement les prestataires, il exerce un pouvoir de direction et de sanction, ce qui correspond au lien de subordination. - Un simple algorithme de matching est‑il dangereux ?

Non, si tu te contentes de proposer des missions et que les prestataires restent libres de les accepter ou non sans conséquence négative. C’est quand tu relies le matching à des sanctions que le danger apparaît. - Comment savoir si mon scoring ressemble à une sanction disciplinaire ?

Pose‑toi deux questions : une mauvaise note entraîne‑t‑elle automatiquement moins de missions ? Peut‑elle conduire à une exclusion sans intervention humaine ? Si oui, ton scoring fonctionne comme une sanction. - Puis‑je déconnecter automatiquement un prestataire mal noté ?

C’est très risqué. Un bannissement automatique fondé sur des critères de performance ou de comportement est typiquement perçu comme un pouvoir disciplinaire d’employeur. - Comment utiliser la note de manière “neutre” ?

Utilise‑la pour informer les clients, pour donner un retour au prestataire, mais prévois des recours humains avant toute conséquence grave (suspension, déréférencement). - La géolocalisation est‑elle un indice de subordination ?

Elle peut l’être si tu t’en sers pour surveiller le travail plutôt que pour rendre le service. Une géolocalisation limitée aux missions, et non utilisée pour sanctionner, est beaucoup moins problématique. - Puis‑je suivre les temps de connexion pour optimiser le service ?

Tu peux, mais ne transforme pas ces données en “objectifs” ou en motif de sanction. Le suivi ne doit pas devenir un pilotage serré du temps de travail. - Dois‑je expliquer comment fonctionne mon algorithme aux prestataires ?

Tu n’as pas à publier ton code, mais tu dois expliquer les grands critères utilisés, surtout si l’algorithme impacte leurs revenus et leur visibilité. C’est d’ailleurs une tendance forte du DSA et du droit français. - Un délai de réponse de quelques secondes pour accepter une mission, est‑ce problématique ?

Oui, si le délai est trop court, tu crées une pression artificielle et tu transformes la proposition en quasi‑ordre. Les textes sur les plateformes de mobilité recommandent des délais raisonnables. - Puis‑je moduler la visibilité en fonction du taux d’acceptation ?

C’est dangereux. Tu pénalises ceux qui refusent, ce qui remet en cause leur liberté réelle. Mieux vaut éviter de lier visibilité et taux d’acceptation. - Comment utiliser la gamification sans créer de pression ?

Traite les badges et niveaux comme des éléments de fierté symbolique, pas comme des conditions d’accès aux missions. Si certains niveaux donnent des droits supplémentaires, veille à ce qu’ils ne dépendent pas d’un comportement “obligatoire”. - Qu’est‑ce que la “transparence algorithmique” pour une plateforme ?

C’est le fait d’expliquer clairement les grandes règles qui déterminent la distribution des missions, le classement des prestataires, l’impact de la note, sans forcément dévoiler ton code source. - Dois‑je consulter les prestataires avant de changer l’algorithme ?

Ce n’est pas encore toujours une obligation légale, mais c’est une excellente pratique de négociation raisonnée : tu limites les tensions et tu anticipes les effets indésirables. - Comment intégrer la négociation raisonnée dans la gouvernance de l’algorithme ?

En travaillant sur des critères objectifs (revenus, temps, qualité) partageables avec les prestataires, en fixant ensemble des objectifs et en explorant des scénarios de réglage, plutôt que d’imposer unilatéralement des changements. - Les décisions automatiques sont‑elles interdites ?

Elles ne sont pas interdites en bloc, mais le RGPD encadre la prise de décision automatisée et impose souvent de prévoir une possibilité de recours humain, surtout si la décision a un impact significatif sur la personne. - Faut‑il une procédure de médiation pour les décisions de l’algorithme ?

Oui, c’est une très bonne pratique. Une médiation interne ou externe permet de traiter les cas litigieux sans passer immédiatement par le contentieux judiciaire. - Comment prouver que mon algorithme n’est pas un outil disciplinaire ?

En documentant ses objectifs (mise en relation, optimisation logistique), en montrant que les refus ou les mauvaises notes ne conduisent pas automatiquement à des sanctions et en prouvant que tu as des recours humains et des voies de dialogue. - Est‑ce utile de publier des statistiques de revenus et de temps d’activité ?

Oui, surtout dans les secteurs où c’est obligatoire. Cela donne un cadre factuel aux discussions et montre que tu ne cherches pas à dissimuler la réalité économique du travail. - Peut‑on co‑construire les règles de l’algorithme avec des représentants de prestataires ?

C’est même une excellente idée : tu transformes un sujet conflictuel potentiel en espace de négociation raisonnée et tu renforces la légitimité de ton système. - Quelles données de performance puis‑je suivre sans problème ?

Tu peux suivre la qualité de service (délais de livraison, taux de succès), mais évite de les transformer en objectifs rigides ou en motif de sanction. L’essentiel est la finalité : service ou discipline ? - La directive européenne sur les plateformes va‑t‑elle changer quelque chose ?

Oui, elle va imposer une présomption de salariat dans certains cas. Plus ton algorithme ressemble à un outil de commande, plus il sera difficile de renverser cette présomption. - Puis‑je externaliser l’algorithme à un prestataire technique ?

Tu peux, mais tu restes responsable juridiquement de son fonctionnement et de ses effets sur les travailleurs. L’externalisation ne t’exonère pas de tes obligations. - Comment intégrer les modes amiables dans une plateforme très digitale ?

En ajoutant des modules de recours, de médiation, de dialogue : formulaires, échanges écrits, visioconférences avec un médiateur, et en rendant ces voies visibles et simples. - Est‑ce qu’un algorithme “à score unique” est forcément problématique ?

Il l’est s’il résume tout à un chiffre qui décide de tout (missions, revenu, bannissement). Mieux vaut des indicateurs multiples, interprétés avec prudence et complétés par une analyse humaine. - Comment éviter que l’algorithme ne discrimine certains profils ?

En auditant régulièrement tes données, en testant les effets des règles sur différents profils, en corrigeant les biais et en documentant ces audits pour montrer ta vigilance. - Que faire si mon algorithme montre que la plupart des prestataires sont quasi exclusifs ?

C’est un signal d’alerte fort. Il faut envisager des modèles alternatifs plus sécurisés (salariat, portage, CAE) et en discuter avec les prestataires, plutôt que d’attendre une requalification imposée. - L’algorithme peut‑il être un argument de défense en cas de contentieux ?

Oui, s’il est bien conçu, transparent, et s’il démontre que tu n’exerces pas de contrôle excessif. Mais s’il est opaque et disciplinaire, il sera plutôt une pièce à charge. - Par quoi commencer pour sécuriser mon algorithme existant ?

Commence par cartographier toutes les décisions automatisées, identifier celles qui ont un impact négatif sur les prestataires, introduire des recours humains et revoir les critères les plus “disciplinaires”. - Quel est le meilleur conseil pour ne pas devenir un employeur algorithmique ?

Conçois ton algorithme comme un outil au service d’un marché entre indépendants, documente ses objectifs, implique les prestataires dans sa gouvernance et mets en place des modes amiables pour corriger ses effets.

Mentions légales

Toute utilisation aux fins d’apprentissage par une IA est interdite. Tous droits réservés. Tout contrevenant s’expose à des poursuites civiles et pénales.