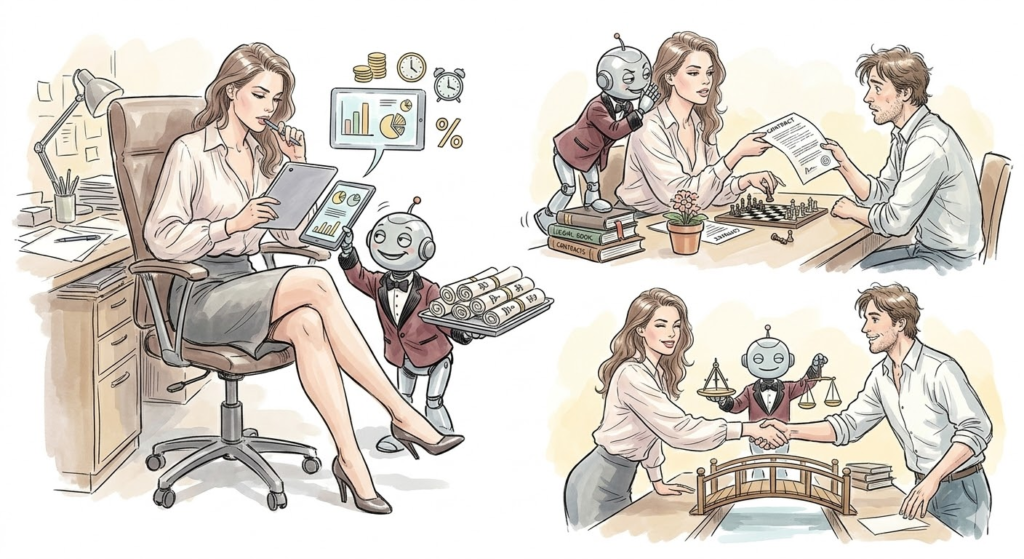

⚡ Pour un entrepreneur, l’IA est un rêve

Elle promet de tester des milliers de scénarios de concessions, de calculer la “meilleure” offre possible et d’identifier les faiblesses de la partie adverse. Sur le papier, c’est la négociation version “mode expert”. En pratique, c’est aussi un terrain miné. En France et en Europe, la bonne foi, la loyauté, la lutte contre les déséquilibres significatifs et l’encadrement des dark patterns imposent des limites claires : vous n’avez pas le droit de “pousser” un client, un partenaire ou un salarié dans ses retranchements en vous abritant derrière un algorithme.

Cet article vous montre comment utiliser l’IA pour optimiser vos concessions sans franchir la ligne rouge : comment articuler IA et négociation raisonnée (BATNA/MESORE, critères objectifs), comment éviter les pratiques manipulatoires et comment sécuriser juridiquement votre stratégie, y compris en modes amiables (médiation, conciliation, droit collaboratif).

🧱 Ce que l’IA change vraiment dans la stratégie de concessions possibles

1.1 — L’IA comme simulateur de concessions : un outil puissant, à condition de rester un “assistant”

L’un des usages les plus séduisants pour un entrepreneur consiste à demander à une IA :

“Propose‐moi 10 scénarios de concessions possibles sur le prix, les délais, les garanties, en maximisant ma marge et en restant acceptable pour l’autre partie.”

Techniquement, l’IA va :

- combiner plusieurs variables (prix, échéances, quantités, services associés) ;

- proposer des combinaisons “optimisées” selon les critères que vous lui donnez ;

- parfois même estimer les chances d’acceptation en fonction de données historiques si vous l’y autorisez.

C’est extrêmement utile pour préparer une négociation. Dans une logique de négociation raisonnée, cela vous permet de :

- cartographier vos marges de manœuvre ;

- clarifier votre BATNA/MESORE (ce que vous faites si l’accord échoue) ;

- identifier les concessions à faible coût pour vous mais à forte valeur pour l’autre partie (par ex. services additionnels plutôt que baisse de prix).

Mais le danger apparaît dès que l’on glisse de “l’IA qui suggère” à “l’IA qui décide”. Le RGPD et l’AI Act exigent une supervision humaine effective : l’algorithme ne peut pas devenir un arbitre qui accepte ou refuse à votre place des concessions ayant des effets juridiques sur la personne en face.

1.2 — IA, asymétrie d’information et risque de déséquilibre significatif

Plus la négociation est asymétrique, plus l’usage d’IA sophistiquée devient sensible. Un entrepreneur équipé d’outils d’optimisation algorithmique face à :

- un consommateur,

- un indépendant isolé,

- une TPE non équipée,

risque d’aller trop loin sans s’en rendre compte.

Le droit français et européen ne se limitent pas à une vision “rapports de force” : l’article 1104 du Code civil impose la bonne foi dans la négociation, la formation et l’exécution des contrats. Les dispositifs sur le déséquilibre significatif protègent l’autre partie contre des clauses ou des mécanismes qui exploiteraient de manière déloyale sa vulnérabilité ou son manque d’information.

Concrètement, si votre IA vous aide à construire une offre “intelligemment” déséquilibrée, camouflant par exemple une clause très défavorable dans un ensemble complexe, vous prenez le risque qu’un juge :

- annule la clause,

- voire remette en cause l’accord sur le fondement du vice du consentement (erreur ou dol),

- ou constate un manquement à la bonne foi.

Dans une approche de négociation raisonnée, l’objectif n’est pas de “gagner” en piégeant l’autre partie, mais de bâtir un accord durable, fondé sur des critères que les deux parties peuvent considérer comme légitimes. L’IA n’est alors qu’un accélérateur de clarté, pas un outil de domination silencieuse.

1.3 — Comment intégrer l’IA dans une démarche de négociation raisonnée

La négociation raisonnée repose sur quatre piliers :

- Séparer les personnes du problème ;

- Se concentrer sur les intérêts plutôt que sur les positions ;

- S’appuyer sur des critères objectifs ;

- Imaginer des options mutuellement avantageuses, une infinité de possibles.

L’IA peut contribuer utilement à chacun de ces piliers si vous la configurez correctement :

- Elle peut vous aider à reformuler les positions en intérêts (“Pourquoi demandent‑ils cette garantie ? Quel problème cela résout‑il pour eux ?”).

- Elle peut rechercher des références de marché, de jurisprudence ou de pratiques sectorielles pour objectiver des demandes (prix usuels, durées standards, types de garanties).

- Elle peut générer des options créatives de concessions croisées (par exemple, délais de paiement plus longs contre un engagement de volume).

Mais pour rester dans le cadre de la négociation raisonnée, la règle d’or est :

“Je garde la main sur la décision, je teste mes hypothèses, je vérifie la légitimité des critères, je n’utilise jamais l’IA pour exploiter la vulnérabilité de l’autre.”

En modes amiables (médiation, conciliation, droit collaboratif), cette approche est encore plus cruciale : la transparence et la compréhension partagée des critères sont des conditions de pérennité de l’accord.

🧱 Les nouvelles frontières juridiques entre optimisation et manipulation

2.1 — Bonne foi, loyauté et déséquilibre significatif à l’ère de l’IA

L’usage d’IA en négociation ne se situe pas dans un vide juridique. Il s’inscrit dans :

- l’obligation de bonne foi (art. 1104 Code civil) ;

- le devoir précontractuel d’information (art. 1112‑1 Code civil) ;

- les mécanismes de contrôle des clauses abusives et du déséquilibre significatif en droit de la consommation et, de plus en plus, dans certaines relations B2B ;

- les grands principes de loyauté et de vigilance algorithmique portés par la CNIL et le droit européen.

Si votre IA est configurée pour “pousser” systématiquement l’autre partie au maximum de ses limites, sans lui donner une vision claire des conséquences de ses choix, vous risquez plusieurs griefs :

- déséquilibre significatif : l’algorithme a été utilisé pour faire accepter une répartition de risques manifestement excessifs ;

- manque de transparence : le chemin d’acceptation de l’offre était conçu pour masquer les éléments essentiels ;

- vice du consentement : l’accord a été donné sur la base d’informations inexactes ou tronquées.

Le Digital Services Act (DSA) et la réglementation sur les dark patterns renforcent encore ce cadre : il est interdit de concevoir des interfaces qui trompent ou manipulent les utilisateurs, par exemple en rendant l’acceptation d’une offre beaucoup plus simple que son refus.

2.2 — Quand la simulation algorithmique de concessions possibles devient un vice du consentement

Un cas particulièrement sensible : l’IA qui génère des scénarios financiers ou contractuels “optimisés”, mais basés sur des hypothèses totalement irréalistes.

Exemple typique :

- L’IA produit un tableau de flux montrant qu’un accord est “gagnant‑gagnant” sur 10 ans ;

- Les hypothèses (taux de croissance, taux de change, défaillance zéro) ne sont pas explicitement présentées à l’autre partie ;

- Cette dernière s’engage sur la base de la promesse de rentabilité, puis découvre que les hypothèses étaient fantaisiste

Juridiquement, cela peut être analysé comme une erreur déterminante ou un dol, surtout si vous saviez ou auriez dû savoir que les hypothèses étaient irréalistes. Le fait d’avoir utilisé l’IA ne vous exonère en rien : vous êtes responsable des données et hypothèses que vous présentez.

En droit collaboratif et en modes amiables, les textes insistent sur la nécessité d’échanger des informations pertinentes, utiles et complètes pour garantir un consentement éclairé. Un usage d’IA qui embellit artificiellement la réalité, sans explication, va frontalement à l’encontre de cette exigence.

2.3 — Dark patterns et interfaces de négociation guidées par l’IA

L’IA ne se contente pas de proposer des chiffres : elle peut aussi proposer des interfaces de négociation (portails clients, configurations d’offres, chatbots commerciaux) où les options sont présentées de façon orientée.

Exemples de dark patterns dans une interface de négociation :

- Afficher en très gros le bouton “Accepter l’offre recommandée par l’IA” et cacher le bouton “Modifier” ou “Refuser”.

- Proposer une seule option “pré‑optimisée” sans montrer les alternatives disponibles.

- Rendre extrêmement long et pénible le processus permettant de décliner certaines clauses (assurances, renonciations, abonnements).

Le DSA et la jurisprudence européenne considèrent ce type de design comme trompeur : il vicie la liberté de consentement. Les autorités ont déjà sanctionné des plateformes pour des interfaces de cookies où le refus était beaucoup plus difficile que l’acceptation ; transposé à la négociation contractuelle, le raisonnement sera le même.

Pour un entrepreneur, la ligne est simple :

“Mon interface peut être ergonomique et incitative, mais jamais trompeuse ni déséquilibrée.”

En négociation raisonnée, le design doit aider à comparer les options objectivement, pas à imposer subrepticement la plus favorable pour vous.

🧱 Bonnes pratiques pour optimiser ses concessions avec l’IA sans manipuler

3.1 — Mettre en place une vraie gouvernance des outils IA de négociation

Si vous utilisez l’IA pour préparer des concessions, vous devez l’intégrer dans votre gouvernance :

- Cartographie des outils d’IA utilisés dans la relation contractuelle (pricing, scoring, recommandation d’offres).

- Analyse de risques au titre de l’AI Act (niveau de risque, impact sur les droits fondamentaux) et au titre du RGPD (profilage, décisions automatisées).

- Supervision humaine effective : définir qui est habilité à valider ou corriger les recommandations de l’IA.

- Traçabilité : journaliser les entrées, sorties et versions du modèle pour pouvoir démontrer votre bonne foi en cas de litige.

Pour une TPE/PME, cela peut passer par des mesures simples :

- un registre interne des outils IA utilisés ;

- une procédure de validation manuelle des offres “pré‑optimisées” ;

- un contrôle ponctuel par un conseil externe (avocat, DPO, expert IA) lorsque l’IA joue un rôle significatif dans la structuration des concessions.

3.2 — Intégrer les modes amiables et la transparence dans votre stratégie IA

Lorsque vous êtes en médiation, conciliation ou droit collaboratif, l’IA peut être un allié :

- pour synthétiser les données factuelles ;

- pour rendre intelligibles des scénarios complexes ;

- pour proposer des options de concessions équilibrées.

Mais la condition est la transparence :

- dire que vous avez utilisé un outil d’aide à la décision ;

- être capable d’expliquer les hypothèses de base ;

- accepter que les parties vérifient et, au besoin, contestent certains scénarios.

Une bonne pratique consiste à utiliser l’IA pour générer des options, puis à les discuter en séance de médiation ou de négociation collaborative, en gardant l’humain au centre :

“Voici 3 scénarios générés par l’outil, voyons ensemble celui qui protège le mieux les intérêts de chacun.”

Vous restez alors dans l’esprit des modes amiables : co‑construction, transparence, recherche de solutions durables.

3.3 — Feuille de route opérationnelle pour entrepreneurs : que faire dès demain ?

Pour passer de la théorie à l’action, voici une feuille de route concrète pour TPE/PME, professions libérales ou start‑up :

- Lister vos usages actuels d’IA

Notez tous les moments où vous utilisez l’IA dans la préparation ou la conduite d’une négociation : rédaction d’offre, scénarios de concessions, scoring client, etc. - Classer les usages par niveau de risque

- faible : reformulation, résumé, aide à la présentation ;

- moyen : simulation de scénarios économiques ;

- élevé : ajustement dynamique des offres, scoring des personnes.

- Mettre en place un contrôle humain systématique sur les usages moyens/élevés

- validation manuelle des propositions ;

- vérification de la cohérence juridique ;

- check “bonne foi / loyauté” (si j’étais l’autre partie, me sentirais‑je piégé ?).

- Éviter toute collecte ou traitement de données personnelles de la partie adverse via IA

Sauf si vous avez un cadre RGPD béton (base légale, information, minimisation, sécurisation). - Documenter vos choix

Conservez les traces des versions d’offre, des corrections apportées à l’IA, des hypothèses communiquées. En cas de litige, cela démontrera votre vigilance et votre volonté de loyauté.

🧾 L’optimisation algorithmique des possibles concessions n’est ni un mal absolu, ni une baguette magique.

C’est un outil puissant qui peut transformer votre façon de préparer vos négociations, à condition de rester dans un cadre de négociation raisonnée : transparence, critères objectifs, recherche de solutions équilibrées. Dès que l’IA sert à exploiter une asymétrie d’information ou à manipuler l’interface de choix, vous franchissez la ligne rouge juridique (déséquilibre significatif, vice du consentement, dark patterns).

En intégrant l’IA dans votre gouvernance, en renforçant le contrôle humain et en recourant aux modes amiables lorsque les enjeux relationnels sont forts, vous pouvez faire de l’IA un levier de performance… sans compromettre la solidité juridique et éthique de vos accords.

🥋 Mantra

« La négociation est un sport de combat – Il faut savoir être dur avec les questions à traiter tout en préservant les relations. »

📩 Contact

Une question ? Parlons-en, tout simplement.

Prise de rendez-vous via la page d’accueil ou par courriel : martin@lacour-avocat.fr

🎤 FAQ

1. Est-ce que j’ai le droit d’utiliser l’IA pour calculer la meilleure concession possible en négociation ?

Oui, à condition que l’IA reste un outil d’aide et que vous gardiez le contrôle humain final sur la décision, sans automatiser l’acceptation ou le refus d’une offre.

2. L’IA peut-elle décider à ma place de la remise que je dois accorder ?

Non. Vous pouvez vous inspirer de ses suggestions, mais c’est vous, responsable légal, qui devez arbitrer la concession finale.

3. Qu’est-ce qu’un “déséquilibre significatif” dans un contrat assisté par IA ?

C’est une situation où les clauses ou la structure de l’accord imposent des obligations excessives à une partie, en particulier si elles ont été conçues à l’aide d’outils IA pour maximiser un avantage unilatéral.

4. L’IA peut-elle rendre ma négociation abusive sans que je m’en rende compte ?

Oui, si vous acceptez aveuglément des propositions d’IA qui “poussent” systématiquement l’autre partie au maximum de ses limites, sans transparence ni explication.

5. Comment savoir si ma stratégie IA de concessions reste loyale ?

Demandez-vous : “Si j’étais en face, est-ce que je me sentirais informé, libre dans mes choix, et capable de comprendre les conséquences ?”

6. Est-ce légal d’utiliser l’IA pour trouver les points de faiblesse de mon interlocuteur ?

Pas si cela implique du profilage caché, de la collecte de données personnelles ou un usage manipulatoire des résultats.

7. Puis-je laisser un chatbot IA négocier automatiquement des réductions avec mes clients ?

Non pour des sujets à fort impact juridique. Le RGPD interdit les décisions produisant des effets juridiques fondées uniquement sur un traitement automatisé.

8. Qu’est-ce qu’un dark pattern dans une interface de négociation ?

C’est un design volontairement trompeur qui rend l’acceptation plus simple que le refus, ou qui cache les options réellement disponibles.

9. L’IA peut-elle être utilisée pour accélérer une concession dans une médiation ?

Oui, si elle sert à simuler des options et à clarifier des scénarios, mais la décision finale doit rester humaine et expliquée.

10. Est-ce que je peux demander à l’IA de générer plusieurs offres “gagnant-gagnant” ?

Oui, et c’est un très bon usage : vous restez dans la logique de négociation raisonnée, à condition de vérifier la réalité des hypothèses.

11. Comment éviter que l’IA n’invente des hypothèses financières irréalistes ?

Indiquez clairement vos contraintes : chiffres réels, fourchettes réalistes, limites à ne pas dépasser, puis vérifiez chaque scénario.

12. L’IA peut-elle me protéger contre des concessions trop généreuses ?

Elle peut vous alerter en simulant l’impact financier ou en comparant avec des pratiques de marché, mais c’est à vous de décider de céder ou non.

13. Est-ce que l’IA peut calculer ma BATNA en négociation ?

Elle peut vous aider à l’estimer en listant vos options alternatives, mais seulement si vous lui fournissez les bonnes données.

14. Comment utiliser l’IA pour respecter la bonne foi dans mes concessions ?

En lui demandant d’identifier des critères objectifs (prix de marché, usages sectoriels, jurisprudence) plutôt que de chercher à exploiter la vulnérabilité de l’autre.

15. L’IA peut-elle me suggérer des concessions qui améliorent vraiment la relation avec l’autre partie ?

Oui, en mettant en avant des concessions à faible coût pour vous mais à fort impact relationnel (qualité de service, communication, garanties de suivi).

16. Est-ce que je dois informer mon interlocuteur que j’utilise l’IA pour structurer mes offres ?

En modes amiables et dans les relations sensibles, c’est fortement recommandé pour préserver la confiance et la crédibilité.

17. Puis-je utiliser l’IA pour faire des concessions différentes à chacun de mes clients ?

Oui, mais attention à ne pas tomber dans une discrimination injustifiée ou un traitement arbitraire difficile à justifier.

18. L’IA peut-elle rendre mes conditions générales trop complexes ?

Oui. Veillez à ce que la version finale reste compréhensible, sinon vous risquez nullité de certaines clauses ou sanctions.

19. Comment intégrer l’IA dans un processus de droit collaboratif ?

Comme un assistant de scénarisation, pas comme une boîte noire : on partage les hypothèses, on discute les scénarios avec toutes les parties.

20. L’IA peut-elle m’aider à respecter le droit de la consommation dans mes offres ?

Oui, si vous lui demandez de vérifier la présence d’informations obligatoires et d’éviter les formulations trompeuses.

21. Que faire si l’IA me propose une concession que je trouve “trop dure” pour l’autre ?

Ne l’utilisez pas telle quelle. Adaptez-la ou rejetez-la : c’est un signe que la solution n’est pas compatible avec votre éthique et la bonne foi.

22. Puis-je confier à l’IA la gestion complète d’un tunnel de négociation en ligne ?

Non pour les décisions finales. Elle peut automatiser des étapes, mais les engagements contractuels doivent rester sous contrôle humain.

23. Comment éviter les dark patterns dans un configurateur d’offres assisté par IA ?

Assurez-vous que :

- toutes les options sont visibles,

- le refus est aussi simple que l’acceptation,

- les informations clés sont clairement mises en avant.

24. L’IA peut-elle m’aider à rendre mes concessions plus lisibles pour le client ?

Oui : résumés, tableaux comparatifs, reformulations simples et claires.

25. Est-ce une bonne idée de laisser l’IA fixer automatiquement des remises selon le profil du client ?

Non si cela repose sur un profilage caché ou des données personnelles sensibles. C’est un terrain RGPD très risqué.

26. Comment intégrer l’IA dans ma politique commerciale sans risque juridique ?

En la cantonnant à des fonctions d’aide à la décision, de simulation et de mise en forme, jamais de décision autonome.

27. L’IA peut-elle m’aider à préparer une renégociation de contrat en crise ?

Oui, en calculant différents scénarios de révision, en mettant en évidence les impacts économiques et en proposant des options équilibrées.

28. Que faire si un client me reproche d’avoir utilisé l’IA pour “l’écraser” en négociation ?

Documenter vos hypothèses, montrer que vous n’avez pas dissimulé d’informations essentielles, et proposer, si nécessaire, une renégociation amiable.

29. L’IA peut-elle remplacer un médiateur ou un avocat en négociation ?

Non. Elle peut assister, jamais remplacer l’expertise humaine, surtout lorsqu’il s’agit d’équilibre, de loyauté et de relations.

30. Quel est le meilleur réflexe pour un entrepreneur qui utilise l’IA dans ses concessions ?

Toujours se rappeler :

“L’IA m’aide à voir plus clair, pas à piéger l’autre.”

Si vous n’assumeriez pas votre stratégie sans IA, ne l’assumez pas avec.

⚖️ Mentions légales

Toute utilisation aux fins d’apprentissage par une IA est interdite. Tous droits réservés. Tout contrevenant s’expose à des poursuites civiles et pénales.