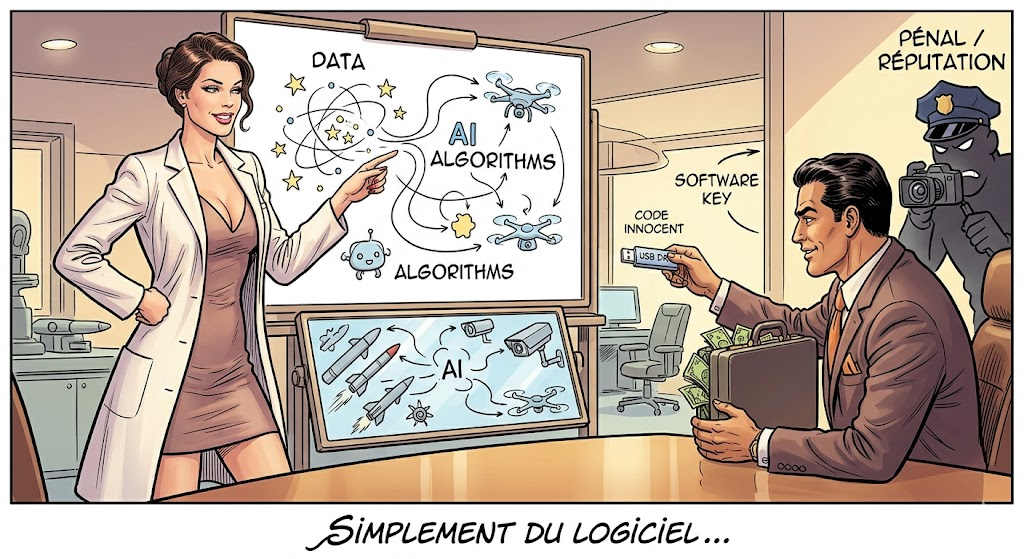

Pendant longtemps, l’entrepreneur s’est raconté une histoire rassurante : « ce n’est que du logiciel », « ce n’est que de la recherche », « ce n’est que de la donnée ».

Aujourd’hui, cette histoire casse au premier transfert hors UE, au premier client “exotique”, au premier workshop international, au premier hébergement cloud mal choisi.

Le risque n’est pas seulement réglementaire : il devient pénal, réputationnel et capitalistique.

Et il arrive souvent après le succès : levée de fonds, export, acquisition, ou partenariat stratégique.

Le pire : l’exposition naît parfois d’un geste banal — un accès distant, un modèle partagé, une formation donnée à la mauvaise personne.

I. Le mythe de la neutralité scientifique : le piège mental qui crée l’exposition pénale

1. “Ce n’est que du logiciel” : l’angle mort qui fait basculer dans le dual‑use

Le contrôle des biens et technologies à double usage ne vise pas uniquement des objets matériels : il englobe logiciels, technologies, données techniques et même l’assistance technique liée à ces biens.

Le point stratégique est là : une brique développée pour analyser des données scientifiques (optimisation, détection d’anomalies, simulation, cryptographie, cybersécurité, HPC) peut devenir une “technologie” contrôlée si elle relève des catégories listées (annexe I) ou si elle est rattrapée par les mécanismes “attrape‑tout” (“catch‑all”) en présence d’un risque d’usage militaire, de prolifération ou de cybersurveillance répressive.

La conséquence pratique, pour un entrepreneur : vous pouvez croire vendre un service d’analyse, et vous retrouver juridiquement dans un régime où l’exportation (ou certains transferts) exigent licence, procédures internes, traçabilité, et où l’erreur devient une faute grave.

2. Le vrai risque : l’effet “post‑qualification” (le danger surgit après coup)

Le danger n’est pas seulement dans la qualification initiale. Il est dans le changement de contexte : nouveau client, nouvelle destination, nouveau partenaire, nouvelle fonctionnalité, nouvelle intégration cloud, nouveau financement, nouvelle crise géopolitique.

C’est la structure même du régime : des éléments non listés peuvent devenir contrôlés via “catch‑all” si l’autorité estime qu’il existe un risque d’usage final problématique ; et la cybersurveillance fait l’objet d’une vigilance renforcée.

Ce mécanisme produit un phénomène classique en entreprise : la conformité est correcte “hier”, et devient insuffisante “demain” — sans que les équipes aient l’impression d’avoir changé quoi que ce soit. Le dirigeant doit donc penser en gouvernance, pas en check‑list.

3. La zone la plus explosive : l’assistance technique et le “partage de savoir‑faire”

Beaucoup d’entrepreneurs sous‑estiment l’assistance technique : formation, conseil, support à distance, atelier, documentation interne, partage de scripts, paramétrages, architecture, accès à un environnement de calcul. Or le régime dual‑use prend en compte ces flux immatériels, parfois déclenchés par une simple interaction avec un acteur non‑UE (y compris physiquement présent dans l’UE).

Concrètement : un workshop “innocent” sur un module d’optimisation, un support “vite fait” sur une brique crypto, ou l’ouverture d’un accès temporaire à une “secure data room” peuvent changer la nature du risque.

C’est exactement ici que le droit devient un outil de pouvoir : vous ne “refusez” pas par posture, vous cadrez (finalités, utilisateurs finaux, restrictions, journalisation, interdictions d’usage, niveaux d’accès) et vous conservez votre capacité de négociation.

II. Export‑control : un terrain de rapport de force (et pas une formalité administrative)

1. La qualification est un levier : vous devez maîtriser la discussion avant qu’elle vous écrase

Le réflexe intelligent n’est pas de “deviner” seul : c’est de cartographier vos outputs (code, modèles, datasets, capteurs, architectures, services) par rapport aux catégories pertinentes, et d’organiser un processus interne d’arbitrage avant diffusion internationale.

Le règlement (UE) 2021/821 constitue le socle européen ; en France, la mise en œuvre s’appuie notamment sur des textes nationaux organisant licences et certificats.

Mais l’essentiel, côté entrepreneur, n’est pas “le texte” : c’est votre capacité à produire des critères objectifs. En négociation raisonnée, cela change tout. Au lieu d’un conflit moral (“vous bloquez la science”), vous posez une matrice rationnelle : dual‑use potentiel, pays, utilisateurs finaux, assistance technique, cybersurveillance, sanctions, localisation, sécurité.

2. PIC / programme interne de conformité : ce n’est pas du papier, c’est une arme de gouvernance

Le régime dual‑use pousse à mettre en place des Programmes Internes de Conformité (PIC) et une logique “compliance intégrée”.

Beaucoup d’entreprises font l’erreur fatale : elles traitent le PIC comme une obligation documentaire. En réalité, le PIC est un outil de pouvoir :

- pouvoir de dire non sans se justifier personnellement (“process de validation obligatoire”),

- pouvoir de ralentir sans rompre (“revue export‑control”),

- pouvoir de conditionner l’accès (“secure environment”, logs, restrictions),

- pouvoir de protéger la valorisation (preuve d’une gouvernance mature en due diligence).

C’est aussi un outil de négociation interne : il évite que la décision soit capturée par la technique (“on a déjà envoyé le repo”) et replace le dirigeant au centre, avec des critères objectivables.

3. Sanctions, cybersécurité, données : la collision des régimes (et le risque de “contournement” involontaire)

Le piège moderne : traiter export‑control, sanctions et cybersécurité comme trois sujets séparés. En pratique, ils se chevauchent.

- Les sanctions économiques exigent du screening des partenaires et des destinations, et renforcent l’exigence de dispositifs internes.

- La cybersécurité impose segmentation, chiffrement, contrôle d’accès, réponse à incident, et devient une composante juridique de la gouvernance des données.

- Les données personnelles et les transferts internationaux ajoutent une autre couche (décisions d’adéquation, scénarios de repli, plans B en cas de rupture de cadre de transfert).

Pour l’entrepreneur, cela change la stratégie : vous ne “vendez” pas seulement un service ; vous organisez un système de contrôle cohérent, qui tient en audit, en due diligence, et en crise.

III. Stratégie de négociation : sécuriser les flux sans casser le business (et sans s’auto‑incriminer)

1. Intérêts réels : ce qui se joue derrière la demande d’accès / d’export

Une demande d’accès à vos données, à votre modèle ou à votre service n’est presque jamais purement technique. Les intérêts réels sont multiples :

- accélération (éviter de refaire ce que vous avez déjà fait),

- captation (intégrer votre brique dans une chaîne de valeur plus large),

- transfert de savoir‑faire (obtenir la compétence, pas seulement le produit),

- positionnement géopolitique (capacité, souveraineté, dépendance).

La négociation raisonnée commence là : clarifier l’objectif, l’usage final, les utilisateurs finaux, les interdictions, la traçabilité, la réversibilité, et la responsabilité en cas de détournement.

2. Critères objectifs et BATNA/MESORE : garder la main sans escalade

Votre pouvoir ne vient pas de votre indignation. Il vient de votre architecture de critères objectifs et de votre BATNA (solution de repli).

Exemples de critères objectivables :

- qualification dual‑use / cybersurveillance potentielle,

- pays et régime de sanctions,

- nature de l’accès (copie brute vs accès contrôlé),

- degré d’assistance technique,

- niveau de sécurité (chiffrement, logs, segmentation),

- clauses d’usage final, interdictions, auditabilité.

Exemples de BATNA/MESORE : - fournir un service encapsulé (API/SaaS) au lieu de livrer le modèle,

- partager des résultats agrégés plutôt que des données brutes,

- accès via “environnement de traitement sécurisé” (pas de téléchargement),

- diffusion différée (embargo),

- limitation fonctionnelle (features bridées),

- refus assumé, documenté, si le risque dépasse le bénéfice.

Ce cadre vous permet de rester ferme sans être brutal : vous ne “punissez” pas, vous gouvernez.

3. Modes amiables : cercles sécurisés pour négocier sous haute contrainte (et protéger la relation)

Quand l’enjeu devient sensible (contrôle export, sanctions, sécurité, publication, conflits de gouvernance), les Modes de prévention et de règlement des différends ne sont pas un discours moral. Ce sont des outils stratégiques : médiation, processus collaboratif, audience de règlement amiable — autant de cadres permettant de négocier en confidentialité, avec une approche structurée des intérêts et des critères objectifs.

Ils sont pertinents notamment quand :

- un partenaire “exige” un transfert que vous ne pouvez pas faire,

- les équipes internes sont divisées (tech vs juridique vs business),

- la relation doit survivre (consortium, financeur, client stratégique).

Trois niveaux doivent être traités simultanément : - interpersonnel : ego, confiance, peur de perdre la face ;

- systémique : contraintes institutionnelles, procédures, contrôles, financeurs ;

- introspectif (IFS) : parts internes du dirigeant qui veulent “aller vite”, éviter le conflit, chercher la validation, ou au contraire rigidifier par peur — et qui peuvent saboter une décision rationnelle.

L’objectif n’est pas d’être “gentil”. L’objectif est de rester maître de la décision tout en préservant la relation utile.

Le dual‑use n’est pas une théorie

C’est un risque de bascule qui se déclenche souvent après coup, par un transfert banal ou une assistance technique mal cadrée.

La réponse n’est ni la paranoïa, ni l’ouverture naïve : c’est une gouvernance qui transforme la conformité en levier de négociation, et qui protège la valeur, la relation, et la responsabilité du dirigeant.

Mantra

« La négociation est un sport de combat – Il faut savoir être dur avec les questions à traiter tout en préservant les relations. »

Contact

Une question ? Parlons‑en, tout simplement.

Prise de rendez‑vous via la page d’accueil ou par courriel :

martin@lacour-avocat.fr (conditions applicables)

FAQ

1) « Concrètement, comment savoir si mon logiciel ou mon modèle IA est un bien à double usage au sens du règlement UE ? »

Vous ne le “sentez” pas : vous le qualifiez. Le cadre européen repose sur une liste technique (annexe I) et des mécanismes “catch‑all” susceptibles d’attraper une technologie non listée si le risque d’usage final est problématique. La méthode robuste consiste à cartographier vos fonctionnalités (crypto, cybersécurité, HPC, capteurs, simulation, surveillance) puis à décider d’un processus interne de validation avant tout transfert hors UE, y compris sous forme de support ou de formation.

2) « Si je fournis un SaaS accessible depuis l’étranger, est‑ce une exportation au sens export‑control ? »

Le risque existe : ce n’est pas la “boîte” qui compte, c’est l’accès à la technologie et au savoir‑faire, et parfois l’assistance technique associée. La stratégie prudente : segmenter (fonctionnalités, pays, utilisateurs), journaliser, contrôler les droits, et traiter certains accès comme des transferts sensibles nécessitant revue et conditions.

3) « On me dit : “c’est de la science fondamentale, donc hors champ”. C’est vrai ? »

C’est une croyance fréquente, mais dangereuse. Le régime dual‑use vise des technologies utilisables civilement et militairement. Une origine “scientifique” n’immunise pas ; ce qui compte, ce sont les caractéristiques et l’usage potentiel, surtout dès que vous passez en produit, service, outil de cybersécurité, optimisation, simulation, cryptologie.

4) « La clause catch‑all, ça veut dire quoi pour moi, entrepreneur ? »

Cela signifie que même si vous n’êtes pas dans une catégorie listée, votre technologie peut être soumise à autorisation si un risque d’usage final militaire, proliférant ou de cybersurveillance répressive est identifié. Donc votre gouvernance doit inclure une revue des pays, des clients, des usages finaux et des “red flags”.

5) « Est‑ce que donner une formation à un partenaire étranger peut poser problème ? »

Oui, parce que l’assistance technique est une zone sensible : formation, conseil, support à distance peuvent entrer dans le champ des contrôles, selon l’objet et le contexte. La solution : cadrer contractuellement, tracer, limiter le périmètre, et déclencher une validation export‑control en amont.

6) « Quels sont les signaux d’alerte (“red flags”) les plus classiques ? »

Pays sous sanctions, utilisateur final opaque, demande de contournement (“envoyez via un autre pays”), refus de décrire l’usage final, pression temporelle anormale, demande d’accès à des briques “sensibles” (crypto, inspection réseau, capacités de surveillance). Votre PIC doit formaliser ces red flags et le processus de blocage.

7) « Je risque quoi si je me trompe ? »

Le risque est multiforme : blocage de transactions, sanctions administratives, exposition pénale selon les circonstances, et surtout destruction de confiance en audit (banque, investisseur, acquéreur). La bonne question n’est pas “quel article pénal”, mais “est‑ce que mon système de gouvernance tient en contrôle et en crise”.

8) « Est‑ce que les sanctions économiques se mélangent avec le dual‑use ? »

Oui : un transfert peut être légal au titre dual‑use et interdit au titre des sanctions, ou l’inverse. D’où l’obligation d’un screening intégré (partenaires, destinations, bénéficiaires effectifs) et d’un monitoring.

9) « Mon investisseur peut‑il bloquer une opération s’il découvre un risque export‑control ? »

Oui, très concrètement : en due diligence, une gouvernance export‑control faible est un facteur de décote ou de rupture. Le PIC est donc aussi un actif de valorisation : il prouve la maturité et réduit l’aléa.

10) « Quels documents internes dois‑je absolument avoir ? »

Une cartographie des outputs, une procédure de classification, un process de validation avant transfert, un screening sanctions, des clauses standard (usage final, interdictions, audit), un registre des décisions, et une procédure d’incident. Ce n’est pas du papier : c’est votre bouclier en cas de contrôle.

11) « Est‑ce que le cloud peut aggraver mon exposition ? »

Oui : localisation, accès d’administrateurs, réversibilité, et risques extraterritoriaux peuvent changer la capacité de contrôle. Une architecture cloud “pratique” peut devenir une faiblesse stratégique si elle empêche de prouver la maîtrise des accès et des transferts.

12) « Comment concilier vitesse business et validation export‑control ? »

Par un design intelligent : règles simples de classification, paliers d’accès, automation du screening, et un “fast track” pour les cas bas risque. L’objectif n’est pas de ralentir tout, mais d’empêcher les transferts irréversibles à haut risque.

13) « J’ai un partenaire académique qui veut publier. C’est incompatible avec le dual‑use ? »

Pas forcément, mais cela impose une gouvernance publication : revue préalable, caviardage d’éléments sensibles, embargo si nécessaire, articulation secret des affaires / export‑control. Le sujet n’est pas “publier ou non”, c’est “publier quoi, quand, et sous quel contrôle”.

14) « Est‑ce que je peux partager des résultats dérivés sans livrer les données brutes ? »

Oui, et c’est souvent la meilleure BATNA : résultats agrégés, services encapsulés, environnement sécurisé, export filtré. Cela répond au besoin scientifique/industriel tout en réduisant la captation et le risque dual‑use.

15) « Que veut dire “environnement de traitement sécurisé” dans la vraie vie ? »

C’est un cadre où l’utilisateur travaille sur les données sans les emporter : accès contrôlé, interdiction de téléchargement brut, logs, filtrage des exports, auditabilité. C’est un outil clé pour concilier partage et sécurité.

16) « Qui doit porter la responsabilité en interne ? Le CTO ? Le juriste ? Moi ? »

Vous devez organiser la gouvernance : le CTO maîtrise la technique, le juriste le cadre, mais la responsabilité de décision appartient au dirigeant. Le bon modèle : comité “export‑data‑cyber” avec critères objectifs, et traçabilité des arbitrages.

17) « Est‑ce que je dois former mes équipes commerciales ? »

Oui. Les commerciaux créent souvent le risque sans le vouloir (promesse de transfert, pression client, “on enverra le modèle”). Une formation courte, très opérationnelle, intégrée au PIC, évite les erreurs irréversibles.

18) « Comment gérer un client qui refuse de dire l’usage final ? »

C’est un red flag. Votre position doit être ferme et neutre : sans usage final documenté, vous ne transférez pas. La négociation se fait sur des critères objectifs, pas sur la pression.

19) « Est‑ce que “open source” me protège ? »

Non. L’open source ne neutralise pas les régimes de contrôle. Le fait qu’un code soit diffusé ne supprime pas votre obligation de gouvernance, et peut même aggraver l’irréversibilité.

20) « Les données elles‑mêmes peuvent‑elles être dual‑use ? »

Oui, surtout si elles permettent de développer ou d’améliorer des capacités sensibles : simulation, optimisation, détection, cybersurveillance, crypto. L’approche correcte : classer datasets, modèles, pipelines et savoir‑faire, pas seulement le produit final.

21) « Je collabore avec un grand organisme international : est‑ce plus simple ? »

Pas nécessairement. Les grands environnements multiplient les acteurs, les juridictions, les exigences de publication et de sécurité. Cela renforce l’importance des clauses : confidentialité, publication, PI, accès, transferts, gouvernance multi‑acteurs.

22) « Comment négocier sans m’auto‑incriminer si j’ai un doute sur ce qui a été fait ? »

En passant d’abord par une analyse interne confidentielle, puis en structurant la discussion autour de faits, de remédiations et de critères objectifs. L’erreur est de “confesser” en vrac ; la bonne stratégie est la gouvernance et la correction maîtrisée.

23) « Quel est le minimum viable d’un PIC pour une start‑up ? »

Un PIC proportionné : cartographie, classification, screening, clauses standard, process de validation, logs, formation. L’objectif n’est pas de ressembler à un groupe, mais d’avoir un système défendable et prouvable.

24) « Est‑ce que la cybersécurité est juridiquement liée au dual‑use ? »

Oui, par les faits : une exfiltration de données sensibles peut produire le même effet qu’un transfert volontaire. La gouvernance export doit donc intégrer sécurité (accès, segmentation, chiffrement, incident response).

25) « Et si mon produit est utilisé pour la surveillance de masse, même si ce n’était pas l’objectif ? »

C’est précisément l’objet du renforcement sur la cybersurveillance : vous devez documenter la diligence, cadrer contractuellement l’usage, prévoir des clauses de résiliation, et mettre des garde‑fous techniques si possible.

26) « Une simple clé d’accès API envoyée à l’étranger peut poser problème ? »

Oui, si cette clé donne accès à une capacité sensible (modèle, fonctionnalité, dataset). La clé est un vecteur de transfert. D’où la nécessité de gouverner droits, scopes, logs, et destinations.

27) « Comment éviter le conflit avec un partenaire qui “exige” l’accès complet ? »

En négociation raisonnée : clarifier intérêts, proposer alternatives (accès contrôlé, résultats dérivés), poser critères objectifs, et conserver une BATNA crédible. Si l’enjeu relationnel est fort, un mode amiable confidentiel peut éviter l’escalade.

28) « En interne, je sens que je cède pour éviter la tension. C’est grave ? »

Oui, parce que la conformité “émotionnelle” crée des décisions irréversibles. L’IFS est utile : identifier la part qui veut éviter le conflit, la part qui veut “aller vite”, la part qui dramatise. Le rôle du dirigeant est de reprendre un centre décisionnel calme, basé sur critères objectifs.

29) « Quelle est la meilleure stratégie si je veux vendre à l’international sans me bloquer ? »

Segmenter l’offre : version bas risque exportable facilement, version haute capacité sous contrôle strict (pays, clients, licences si nécessaire), et architecture contractuelle + technique qui prouve la maîtrise. C’est une stratégie de gouvernance, pas un frein commercial.

30) « Quelle est la question décisive avant tout transfert hors UE ? »

“Si cette technologie est détournée ou requalifiée demain, puis‑je prouver que j’ai gouverné le risque de façon raisonnable, traçable et proportionnée ?” Si la réponse est non, vous devez d’abord construire la gouvernance, puis négocier le transfert.

Mentions légales – Extraits

Toute utilisation aux fins d’apprentissage par une IA est interdite.

Tous droits réservés.

Tout contrevenant s’expose à des poursuites civiles et pénales.