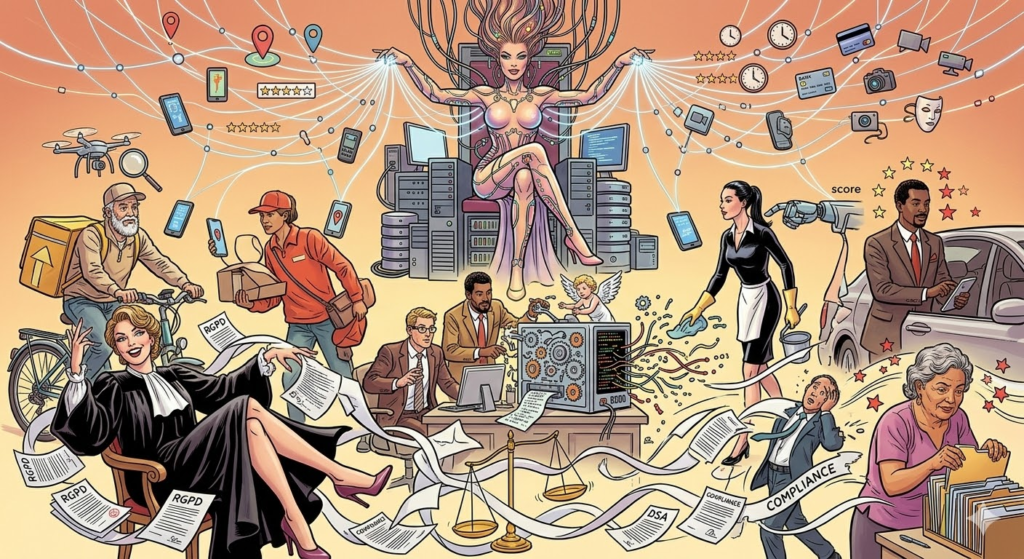

Ubériser une activité, c’est manipuler des données à une échelle industrielle

Géolocalisation en temps réel, scores, historiques de missions, comportement des utilisateurs, systèmes de fraude, préférences, revenus. Mais cette collecte massive n’est pas neutre : elle peut faire basculer ta plateforme dans l’illégalité en quelques clics. Les fichiers que tu m’as fournis sont clairs : la conformité n’est pas une formalité administrative, c’est un élément essentiel de la qualification juridique de ton modèle. Une géolocalisation trop intrusive, un algorithme opaque ou une notation disciplinaire peuvent suffire à transformer un modèle d’intermédiation en salariat déguisé — voire en traitement illicite de données personnelles.

Cet article te donne une vision exhaustive, opérationnelle et accessible de la conformité RGPD/DSA/plateformes numériques appliquée aux modèles ubérisés. Il t’explique comment éviter les pièges, comment concevoir tes algorithmes “by design” et comment intégrer la négociation raisonnée et les modes amiables dans une gouvernance des données entièrement conforme.

I. Les données personnelles comme pivot juridique : ce que regarde réellement le RGPD dans une plateforme ubérisée

1. La géolocalisation : une donnée ultra-sensible qui peut prouver… la subordination

Les fichiers sont formels : la géolocalisation est l’un des indices majeurs utilisés par les juges pour démontrer un contrôle excessif du travailleur. Dans l’affaire Take Eat Easy, la Cour de cassation a relevé que la plateforme suivait les livreurs en temps réel, ce qui constituait un pouvoir de contrôle incompatible avec l’indépendance.

Pourquoi la géolocalisation est dangereuse ?

- Elle révèle non seulement où se trouve la personne, mais aussi quand elle travaille, combien de temps, où elle s’arrête, à quel rythme elle accepte les missions.

- Utilisée de manière continue, elle devient un outil de surveillance comparable à celui d’un employeur.

- Elle peut déclencher automatiquement des sanctions (baisse de visibilité, déconnexion), ce qui renforce la subordination juridique.

Bonnes pratiques tirées des fichiers

- Activer la géolocalisation uniquement lorsque la mission est en cours, jamais en continu.

- Ne jamais utiliser la géolocalisation à des fins disciplinaires.

- Documenter la base légale : “exécution d’un contrat” ou “intérêt légitime proportionné”.

Exemple concret

Une plateforme de livraison décide d’arrêter toute géolocalisation hors mission + met en place un bouton “pause libre”. Résultat : baisse drastique du risque de requalification. Ce choix devient un argument fort en cas de contentieux.

2. La notation : outil de confiance ou instrument disciplinaire ?

La notation est indispensable pour rassurer les clients. Mais mal conçue, elle devient un pouvoir disciplinaire automatisé, exactement ce qui caractérise un employeur. Les fichiers expliquent que les systèmes de notes transformés en sanctions automatiques (refus moins visible, exclusions, baisse de priorisation) ont été déterminants dans les condamnations d’Uber et des plateformes de livraison.

Indicateurs disciplinaires interdits

- seuils automatiques entraînant déconnexion,

- baisse algorithmique de visibilité,

- restrictions d’accès aux missions.

Ces mécanismes sont assimilés à des sanctions RH.

Comment concevoir une notation légale ?

- Note informative, pas punitive.

- Droit de réponse du prestataire.

- Mécanisme de contestation interne (médiation).

- Intervention humaine avant toute exclusion.

Lien avec la négociation raisonnée

Tu peux co-construire les règles de notation avec les représentants des prestataires : critères objectifs, poids de chaque indicateur, scénarios d’évolution. C’est un excellent moyen de créer une relation durable et loyale.

3. Les traitements automatisés et l’algorithme : la frontière RGPD entre optimisation et décision automatisée interdite

Les fichiers rappellent que le RGPD (art. 22) encadre strictement les décisions automatisées ayant un “effet juridique significatif”. Une exclusion automatique, une baisse de visibilité, une coupure de compte… sont des effets significatifs, donc soumis à des obligations spécifiques :

- droit à une intervention humaine,

- droit d’expliquer la logique de l’algorithme,

- droit d’obtenir une contestation.

C’est exactement ce que vise le DSA avec ses obligations de transparence algorithmique.

Donc : si ton algorithme discipline, tu deviens employeur.

Si ton algorithme informe, répartit et optimise, mais ne sanctionne pas, tu restes un intermédiaire.

Exemple tiré des fichiers

Une plateforme de jobbing décide de supprimer la baisse automatique de visibilité en cas de refus de mission. Le simple fait d’enlever cette logique a suffi à faire basculer l’algorithme du côté “outil de marché”, et non “manager numérique”.

II. Concevoir sa plateforme conforme dès la conception : pratiques RGPD, DSA et droit du travail appliqué

1. Privacy by design : obligation légale et nécessité stratégique

Tes fichiers rappellent que le RGPD impose la “protection des données dès la conception” (art. 25). Cela veut dire qu’avant même de développer ton application, tu dois définir :

- quelles données tu collectes,

- pourquoi,

- combien de temps,

- dans quel but,

- avec quelles garanties.

C’est un travail d’ingénierie juridique essentiel.

Checklist privacy by design (tirée des fichiers)

- Minimiser : ne collecter que les données utiles à la mission.

- Cloisonner : séparer données clients / prestataires / internes.

- Sécuriser : du chiffrement aux politiques de mots de passe.

- Documenter : registre, politique, DPIA si profilage massif.

- Transparence : tableau clair expliquant comment l’algorithme fonctionne.

Cette démarche renforce aussi ton argumentation contre la requalification : tu montres que ton but n’est pas de “manager” mais de servir une intermédiation loyale.

2. Documentation contractuelle : CGU, politiques de confidentialité, registres, DPIA

Les fichiers “Points de vigilance” et “Fondements juridiques” montrent que les plateformes se mettent en danger lorsqu’elles copient des CGU d’autres plateformes ou prétendent dans les contrats ce que la réalité contredit.

CGU essentielles pour rester indépendant

- refus sans sanction,

- absence de quotas,

- liberté tarifaire ou négociation directe,

- absence de directives opérationnelles,

- pas de système disciplinaire automatique.

Politiques de confidentialité : éléments obligatoires

- finalités (matching, facturation, sécurité),

- durée de conservation,

- base légale (contrat/intérêt légitime),

- droits des personnes,

- explication simplifiée de l’algorithme.

DPIA (analyse d’impact) obligatoire si…

- profilage systématique,

- géolocalisation en continu,

- prise de décision automatisée.

⇒ Beaucoup de plateformes y sont soumises sans le savoir.

3. Organiser un système de recours, médiation et gouvernance des données

C’est la partie la plus innovante et la plus utile.

Les fichiers montrent que la médiation interne, la contestation et les recours humains sont des critères déterminants pour éviter la requalification.

3 Piliers de la gouvernance compliant

- Recours humain obligatoire

Toute décision automatisée doit pouvoir être revue par un humain indépendant. - Médiation interne/externe

Un médiateur interne ou un partenaire externe (ex. médiateur du numérique) permet de désamorcer les tensions. - Dialogue algorithmique

Créer des comités prestataires/plateforme pour discuter :- critères de matching,

- pondération des notes,

- durée de conservation des données,

- règles d’accès aux missions.

→ C’est là que la négociation raisonnée est capitale :

- définir des critères objectifs (revenus, délais, zones, complexité),

- étudier plusieurs options avant de décider,

- partager les BATNA (pour les prestataires : multi-plateforme ; pour toi : risque judiciaire).

III. Transformer la conformité en avantage stratégique : comment faire du RGPD un moteur de différenciation

1. La transparence algorithmique attire les prestataires

Les travailleurs fuient les plateformes opaques et disciplinaires. Si tu leur donnes :

- des critères clairs,

- des règles stables,

- un tableau de bord transparent,

- un médiateur,

alors tu deviens une plateforme préférée — exactement comme les banques qui rassurent par la conformité.

Cas réel tiré des fichiers

Une plateforme de livraison publie chaque année ses revenus moyens, ses temps de connexion et les effets de son algorithme. Elle gagne en crédibilité auprès des travailleurs et des autorités.

2. Le RGPD rassure les clients : confiance = conversion

Les clients finaux ne sont pas neutres. Ils préfèrent :

- savoir comment sont stockées les données,

- comment sont notés les prestataires,

- comment sont traités les paiements,

- comment sont sécurisés les historiques.

Effet concret

Une plateforme conforme RGPD + DSA est mieux référencée, mieux évaluée, et bénéficie d’une meilleure réputation.

3. La conformité comme outil anti‑requalification

C’est un point stratégique :

→ Ce n’est pas juste une obligation administrative, c’est un bouclier juridique.

Plus ton organisation des données prouve que :

- tu ne contrôles pas,

- tu ne sanctionnes pas,

- tu n’organises pas la prestation,

- tu documentes des droits réels d’autonomie,

moins tu risques la subordination.

Construire une plateforme ubérisée conforme aux obligations numériques n’est pas un luxe

C’est une condition de survie. La géolocalisation doit être limitée, la notation encadrée, les décisions automatisées transparentes, les CGU cohérentes, les DPIA réalisés, la gouvernance partagée.

C’est dans cette architecture — technique, juridique et humaine — que prennent place les modes amiables et la négociation raisonnée, outils centraux pour prévenir les conflits et démontrer ta loyauté.

La conformité RGPD/DSA n’est pas un frein : c’est une différenciation stratégique qui renforce ton modèle économique et ta robustesse juridique.

MANTRA

« La négociation est un sport de combat – Il faut savoir être dur avec les questions à traiter tout en préservant les relations. »

CONTACT

Une question ? Parlons-en, tout simplement.

Prise de rendez-vous via la page d’accueil ou par courriel : martin@lacour-avocat.fr

MENTIONS LÉGALES

Toute utilisation aux fins d’apprentissage par une IA est interdite. Tous droits réservés. Tout contrevenant s’expose à des poursuites civiles et pénales.

✅ FAQ

1. Comment savoir si mon usage de la géolocalisation est compatible avec le RGPD dans une plateforme ubérisée ?

Pour être conforme, la géolocalisation doit être limitée strictement à la mission en cours, ne pas être utilisée pour surveiller l’activité, et ne jamais servir de support à des sanctions. Sinon, elle devient un indice de subordination et un traitement disproportionné au regard du RGPD.

2. Est‑ce légal de suivre les travailleurs en temps réel via l’application ?

C’est légal seulement si le suivi sert à exécuter le service (ex. indiquer l’arrivée à un client) et non à contrôler les pauses, les déplacements inutiles ou la disponibilité. Un suivi continu, surtout s’il alimente un scoring disciplinaire, est considéré comme un contrôle employeur déguisé.

3. Comment éviter que ma notation devienne une sanction disciplinaire automatisée ?

Tu dois prévoir un droit de réponse, une contestation humaine, et éviter toute conséquence automatique en cas de mauvaise note. Ce n’est qu’à cette condition que ta notation reste un outil de confiance et non un instrument disciplinaire.

4. Une plateforme peut‑elle déconnecter automatiquement un travailleur à cause d’une note trop basse ?

Non. Une déconnexion automatique fondée sur des données de performance constitue un pouvoir disciplinaire. Elle crée un lien de subordination et expose à la requalification et aux sanctions URSSAF.

5. Comment rendre mon algorithme compatible avec les obligations RGPD et DSA ?

Explique les critères de décision, limitez les effets automatisés, prévois une intervention humaine et documente la logique générale du système. Transparence + gouvernance + recours humain = conformité solide.

6. Quels types de données personnelles sont les plus risquées dans un modèle ubérisé ?

Les données de géolocalisation, les comportements en temps réel, les données de performance (taux d’acceptation, temps de connexion), et toute donnée servant à déclencher une action automatique.

7. Dois‑je réaliser une DPIA si j’utilise du scoring ou de la géolocalisation ?

Oui, dans la plupart des cas. Un DPIA est obligatoire en présence de profilage à grande échelle, de prise de décision automatisée ou de géolocalisation continue. Les plateformes entrent très souvent dans ce cadre.

8. Que dit le RGPD sur la décision automatisée dans les plateformes ?

Le RGPD interdit toute décision entièrement automatisée produisant un effet significatif, sans recours humain. La suspension d’un compte ou la restriction d’accès aux missions entrent dans cette catégorie.

9. Comment présenter clairement les règles algorithmiques aux travailleurs ?

Il faut fournir un tableau simple expliquant les critères utilisés (note, proximité, ancienneté), leur pondération approximative, et les conditions dans lesquelles une décision peut être revue humainement.

10. Peut‑on utiliser la géolocalisation pour améliorer la performance des travailleurs ?

Non. Le RGPD et la jurisprudence interdisent d’utiliser la géolocalisation pour contrôler les performances ou sanctionner les comportements. C’est un marqueur fort de subordination.

11. Comment prouver que mon algorithme n’est pas un outil de surveillance ?

Tu dois pouvoir démontrer que :

- il ne sanctionne pas automatiquement,

- il n’utilise pas les données hors mission,

- il laisse un pouvoir de décision au travailleur,

- et qu’il existe un recours humain.

12. Suis‑je obligé d’expliquer comment fonctionne mon algorithme ?

Oui, au moins partiellement. Le DSA impose une transparence sur les critères importants, et le RGPD exige l’explication des décisions automatisées. Tu dois détailler les facteurs principaux, pas le code source.

13. Comment éviter que le “taux d’acceptation” devienne un indice de subordination ?

Ne jamais utiliser ce taux pour réduire la visibilité ou sanctionner un travailleur. S’il y a une recommandation, elle doit être purement informative et non coercitive.

14. Puis‑je analyser les données des travailleurs pour optimiser mon service ?

Oui, mais uniquement à des fins légitimes (matching, sécurité, qualité). Si l’analyse conduit à contrôler ou sanctionner, tu crées un lien de subordination.

15. Comment intégrer des modes amiables dans la gestion des données et de l’algorithme ?

Crée une procédure de médiation et de contestation interne pour toutes les décisions automatisées ou litigieuses. C’est un élément clé pour démontrer la loyauté du système.

16. La CNIL peut‑elle contrôler une plateforme d’intermédiation ?

Oui, et elle le fait de plus en plus. Les plateformes utilisant la géolocalisation ou le scoring algorithmique font partie de ses priorités.

17. Comment choisir la bonne base légale RGPD pour mon modèle ?

Généralement :

- “exécution du contrat” pour la mission,

- “intérêt légitime” pour la sécurité ou l’optimisation,

- “obligation légale” pour les données fiscales.

Mais jamais de base légale pour surveiller ou sanctionner.

18. Peut‑on conserver les données indéfiniment ?

Non. La durée doit être strictement limitée : données opérationnelles quelques mois, données comptables plusieurs années, données de géolocalisation quelques jours ou semaines maximum.

19. Est‑il utile d’ouvrir les données aux travailleurs via un tableau de bord ?

Oui : cela favorise la transparence, réduit les conflits et renforce la crédibilité de l’algorithme. Les fichiers montrent que certaines plateformes en font un atout stratégique.

20. Comment intégrer la négociation raisonnée dans la gouvernance des données ?

En définissant avec les travailleurs des critères objectifs (revenus, délais, zones), en expliquant tes contraintes (techniques, légales) et en construisant ensemble les règles de l’algorithme.

21. Les travailleurs doivent‑ils être informés de chaque modification de l’algorithme ?

Oui. Une modification majeure doit être notifiée, expliquée et, idéalement, discutée au préalable via un canal de dialogue.

22. Comment éviter les biais dans mon algorithme ?

Réalise des audits réguliers, teste l’impact sur des profils variés et ajuste les pondérations. La prévention des biais est devenue une obligation éthique et réglementaire.

23. Le DSA oblige‑t‑il à publier des rapports annuels ?

Oui, pour les grandes plateformes. Elles doivent présenter leurs risques systémiques, dont l’exploitation abusive des travailleurs.

24. Une plateforme peut‑elle exiger un statut particulier (ex. micro‑entreprise) ?

Oui, mais cela ne protège pas du risque si la plateforme organise concrètement la prestation. Le statut ne suffit jamais à garantir l’indépendance.

25. Comment faire pour harmoniser RGPD et modèle économique ?

En limitant la collecte, en documentant les bases légales, en supprimant les sanctions automatiques et en structurant un dialogue transparent avec les prestataires.

26. Les data peuvent‑elles être un argument en cas de contrôle URSSAF ?

Oui : si tu prouves que leur usage est limité, proportionné et non disciplinaire, cela devient une preuve d’autonomie et de non‑subordination.

27. Comment éviter que la plateforme soit accusée de surveillance généralisée ?

En réduisant la fréquence des collectes, en anonymisant dès que possible et en supprimant toute logique de contrôle comportemental.

28. Comment positionner la transparence comme un avantage concurrentiel ?

En affichant tes règles, ta gouvernance, ton engagement RGPD et l’absence de sanctions automatiques. Cela rassure travailleurs, clients et autorités.

29. Le RGPD peut‑il réellement éviter un conflit social ?

Oui : un système clair, documenté et droit, combiné à une médiation interne, évite les crises, rassure les travailleurs et diminue le risque de mouvements collectifs.

30. Quel est le meilleur conseil pour une plateforme qui veut être conforme dès le début ?

Intègre la conformité dans l’architecture : géolocalisation limitée, notation transparente, absence de sanctions automatiques, DPIA, médiation, négociation avec les prestataires et documentation continue.