⚡ Médiation, conciliation, droit collaboratif : pour un entrepreneur, ces modes amiables (modes de prévention et règlement des différends) sont souvent la meilleure façon de sortir d’un conflit sans perdre un client, un associé ou un salarié clé.

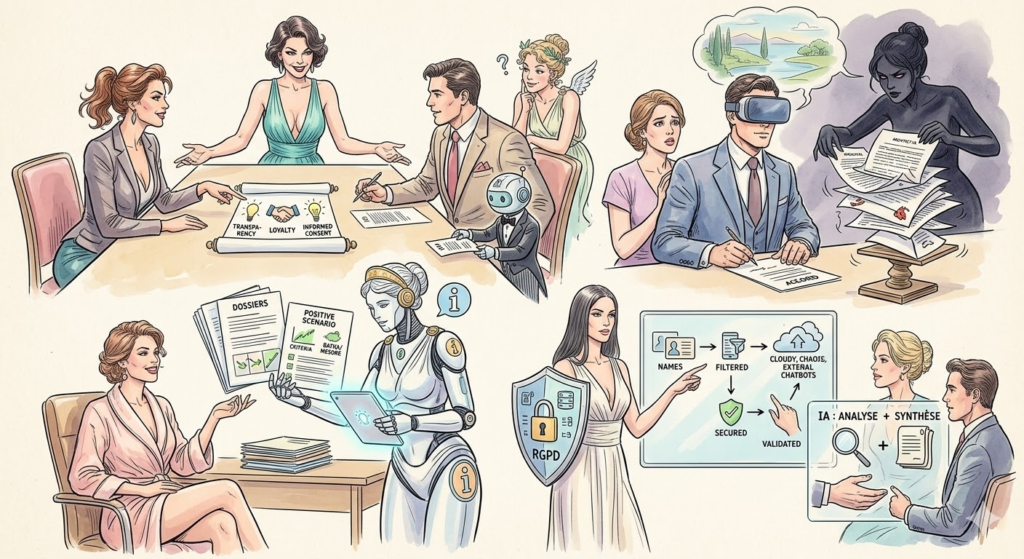

En parallèle, l’IA entre dans tous les bureaux : résumés automatiques, propositions de protocoles d’accord, simulations d’indemnisation. L’outil est tentant, surtout quand le temps et les équipes manquent. Mais mal utilisée, l’IA peut fragiliser le cœur même des modes amiables : la transparence, la compréhension et le consentement éclairé des parties.

Cet article montre, très concrètement, comment un entrepreneur peut utiliser l’IA pour renforcer la médiation, la conciliation ou le droit collaboratif (préparation, clarification, créativité), tout en respectant le RGPD, les exigences de loyauté, et les principes structurants du droit collaboratif et des MPRD. Objectif : garder l’IA comme un assistant discret et fiable, jamais comme une machine à fabriquer des accords bancals ou contestables.

🧱 Pourquoi l’IA bouscule profondément les modes amiables

1.1 — Ce que les modes amiables exigent : transparence, loyauté et consentement réellement éclairé

Les modes amiables (médiation, conciliation, droit collaboratif) reposent sur quelques piliers juridiques et éthiques incontournables :

- la volonté des parties de résoudre le conflit autrement que par le juge ;

- la transparence sur les informations pertinentes : situation économique, contraintes, risques ;

- la loyauté des échanges : pas de rétention d’informations déterminantes, pas de pièges ;

- un consentement éclairé à l’accord final, dans le respect du droit commun du contrat.

En droit collaboratif, ces exigences sont encore plus explicites : la charte impose une obligation de transparence sur les éléments utiles à la résolution du litige, et la pérennité de l’accord repose sur la sincérité des informations partagées. Si une partie découvre ultérieurement que l’autre a caché ou manipulé des données essentielles, la remise en cause de l’accord est envisageable (vice du consentement, recours en révision).

Dans ce contexte, l’introduction d’une IA qui filtre, résume et parfois renverse la présentation des informations n’est jamais neutre. Si l’IA omet un élément clé ou présente un scénario trop optimiste, l’accord n’est plus véritablement fondé sur une information “pertinente, utile et complète”, comme l’exige la doctrine des modes amiables.

1.2 — L’IA comme outil d’aide à la préparation : une vraie valeur ajoutée… si elle reste en coulisse

Utilisée correctement, l’IA est un formidable outil pour préparer une médiation ou un processus collaboratif :

- elle peut résumer des dossiers volumineux (mails, contrats, échanges d’avenants) ;

- elle peut mettre en évidence les points de divergence récurrents ;

- elle peut proposer des listes de critères objectifs (prix de marché, usages sectoriels, standards techniques) ;

- elle peut simuler plusieurs scénarios d’accord (calendrier, indemnisation, modalités de sortie).

Pour un entrepreneur, cela signifie un gain de temps considérable : au lieu d’arriver en médiation avec un sentiment de “flou”, il peut disposer d’une vision structurée de :

- ses intérêts (ce qui compte vraiment : cash, réputation, continuité de la relation, temps) ;

- sa BATNA/MESORE (ce qui se passe si aucun accord n’est trouvé : procès, rupture, réorganisation) ;

- ses marges de manœuvre concrètes en termes de concessions.

Dans la négociation raisonnée, cette préparation est cruciale : elle permet de ne pas négocier “à l’aveugle”, mais à partir de critères rationnels. L’IA, bien paramétrée, peut aider à rendre ces critères plus lisibles.

1.3 — Quand l’IA menace la confiance : accords bancals et vices du consentement

Le problème commence lorsque l’IA quitte les coulisses pour devenir l’architecte principal de l’accord :

- l’IA génère un projet de protocole d’accord avec des clauses standard, parfois inadaptées ;

- des scénarios financiers sont produits avec des hypothèses implicites (croissance, taux, volumes) non expliquées aux parties ;

- des parties signent un texte qu’elles croient “équilibré” car “produit par la machine”, alors qu’il reflète surtout les préférences de celui qui a paramétré l’IA.

Juridiquement, cela ouvre la porte à :

- des vices du consentement (erreur, dol) si des éléments déterminants ont été occultés ou embellis ;

- la remise en cause de la loyauté du processus amiable ;

- une atteinte grave au principe d’information complète et utile.

Mais au‑delà du droit, le risque majeur est la destruction de la confiance : si les parties ont le sentiment que l’IA a été utilisée pour “construire un accord à sens unique”, elles ne reviendront plus jamais vers les modes amiables. L’IA devient alors un anti‑outil de pacification, alors qu’elle pourrait être un accélérateur de compréhension mutuelle.

🧱 Encadrer juridiquement l’usage de l’IA dans les modes amiables : RGPD, transparence et gouvernance

2.1 — RGPD et dossiers de médiation : traiter les données personnelles sans briser la confidentialité

Une médiation ou un droit collaboratif impliquent presque toujours des données personnelles :

- noms, fonctions, adresses ;

- éléments financiers individuels (rémunération, commissions) ;

- parfois des données sensibles (santé, handicap, situation familiale, conflits internes).

Injecter ces données dans une IA (surtout externe, cloud, ou généraliste) est un traitement au sens du RGPD :

- il faut une base légale (souvent exécution du contrat ou intérêt légitime, parfois consentement explicite) ;

- il faut respecter la minimisation (ne mettre que les données strictement nécessaires) ;

- il faut garantir la confidentialité (chiffrement, accès limités, serveurs sécurisés, pas de réentraînement sur les données des parties) ;

- il faut pouvoir documenter ces choix (accountability, registre, analyse d’impact en cas de risque élevé).

En pratique, cela signifie qu’un entrepreneur ne devrait jamais :

- coller brut dans un chatbot grand public des dossiers de médiation avec noms, montants, pièces de santé ;

- laisser un prestataire IA réutiliser ces données pour entraîner son modèle ;

- utiliser un outil IA sans vérifier où les données sont stockées (UE / hors UE).

2.2 — Transparence et loyauté : informer clairement de l’utilisation de l’IA

Les autorités (CNIL, Conseil d’État, AI Act) insistent sur trois principes structurants : loyauté, transparence, vigilance.

Appliqués aux modes amiables, cela impose :

- d’indiquer aux parties si des outils d’IA sont utilisés pour analyser leurs documents ou préparer des projets d’accord ;

- d’expliquer le rôle réel de l’IA : assistant d’analyse, et non décideur ;

- de ne pas se retrancher derrière un « secret d’algorithme » pour refuser de répondre aux questions légitimes d’une partie sur la logique suivie.

Un exemple positif : dans une procédure de médiation commerciale, l’entreprise informe en amont que certains documents seront traités par un outil d’IA interne, en précisant :

- quelles données ;

- pour quelles finalités (synthèse, simulation) ;

- avec quelles garanties (pas de réutilisation externe, chiffrement, supervision humaine).

Cette transparence renforce la confiance au lieu de la fragiliser.

2.3 — Gouvernance et contractualisation : chartes IA, clauses spécifiques et traçabilité

Pour un entrepreneur, sécuriser l’usage de l’IA dans les modes amiables passe aussi par des outils contractuels :

- une charte d’usage de l’IA interne, intégrant des règles claires pour les dossiers de médiation ou de négociation collaborative (types de données autorisées, outils validés, validation juridique) ;

- des clauses spécifiques dans les conventions de médiation ou de droit collaboratif, indiquant si et comment l’IA peut être utilisée (et par qui) ;

- des engagements du prestataire IA (sous‑traitant au sens du RGPD) sur : localisation des données, interdiction de réentraînement, mesures de sécurité, logs.

La traçabilité est centrale : conserver les versions successives d’un projet d’accord généré ou aidé par IA, les hypothèses affichées aux parties, les corrections apportées. En cas de contestation ultérieure (“on ne m’a pas dit que…”), ces traces démontrent votre vigilance et votre bonne foi.

🧱 Bonnes pratiques concrètes pour entrepreneurs : IA au service de la médiation, pas l’inverse

3.1 — Check-list avant d’inviter l’IA dans une médiation ou un processus collaboratif

Avant d’utiliser l’IA dans un mode amiable, un entrepreneur devrait systématiquement passer par une check‑list simple :

- De quoi ai-je vraiment besoin ?

Clarification ? Synthèse ? Simulation ? Reformulation ?

Si vous n’êtes pas clair sur l’objectif, l’IA risque de générer du bruit, pas de la valeur. - Quelles données vais-je fournir à l’IA ?

Si ce sont des données personnelles ou sensibles, êtes‑vous sûr de la base légale, de la minimisation et des garanties de sécurité ? - Où ces données vont-elles aller ?

Outil interne ? Cloud européen sécurisé ? Service non maîtrisé hors UE ?

Si vous ne savez pas répondre, ne mettez pas vos dossiers sensibles dedans. - Comment expliquerai‑je aux parties ce que l’IA a fait ?

Si vous êtes incapable de rendre le processus intelligible, la confiance sera entamée. - Ai‑je prévu un contrôle humain ferme sur tout ce qui sort de l’IA ?

Aucun texte généré ne doit être directement proposé comme accord, sans relecture juridique et vérification par les parties.

3.2 — Articuler négociation raisonnée et IA : BATNA, critères objectifs et options créatives

La négociation raisonnée offre une boussole très utile pour encadrer l’IA :

- l’IA aide à identifier les critères objectifs (jurisprudence, données de marché, standards professionnels) autour desquels structurer la discussion ;

- elle permet de calculer l’impact de différents scénarios par rapport à la BATNA de chaque partie (par exemple, coût comparé d’un contentieux vs. accord) ;

- elle peut générer des options créatives d’aménagement (paiement échelonné, services complémentaires, clauses de revoyure).

Mais l’IA ne doit jamais servir à :

- deviner la psychologie intime de la partie adverse ;

- exploiter sa vulnérabilité pour pousser une option qu’elle ne comprend pas ;

- imposer un “pack” unique présenté comme la seule solution rationnelle.

Un entrepreneur pourra, par exemple, demander :

“Propose trois scénarios de sortie de conflit qui respectent les intérêts financiers des deux parties et réduisent le risque de rupture de la relation.”

Puis, en médiation, ces scénarios sont discutés, ajustés, critiqués, en transparence. L’IA reste un générateur d’options, pas un prescripteur.

3.3 — Trois cas pratiques : commercial, social, santé – comment bien utiliser l’IA en mode amiable

a) Conflit commercial B2B

Une PME fournit depuis des années un grand client qui conteste brutalement une facture importante. Avant d’aller en contentieux, les parties acceptent une médiation. L’entrepreneur utilise l’IA pour :

- résumer les échanges de mails pour identifier les points de friction ;

- simuler plusieurs plans d’apurement (échelonnement, remise partielle, compensation par de futurs contrats).

En séance, il présente ces options comme des hypothèses de travail, en expliquant qu’elles ont été préparées avec un outil numérique. La discussion reste centrée sur les intérêts (cash, continuité de la relation) et sur des critères objectifs (historique de collaboration, contraintes de trésorerie). L’accord final est co‑construit, l’IA ayant simplement accéléré la préparation.

b) Conflit social interne (salarié / employeur)

Dans un conflit sur une rupture de contrat, l’IA peut aider l’employeur à :

- analyser les risques contentieux (jurisprudence en matière d’indemnisation) ;

- simuler plusieurs montants d’indemnité transactionnelle ;

- structurer un projet de protocole soumis ensuite à médiation ou conciliation.

Mais l’employeur doit absolument éviter :

- d’analyser le salarié via ses réseaux sociaux ;

- d’utiliser l’IA pour classer les salariés “à évacuer en priorité” ;

- de “sur‑jouer” le caractère scientifique des simulations pour mettre la pression.

En médiation, l’IA reste en arrière‑plan ; c’est le dialogue, guidé par le médiateur, qui permet de trouver un équilibre acceptable.

c) Conflit patient / établissement de santé

Dans le domaine du soin, les usages d’IA sont très encadrés, y compris sur le plan pénal. En cas de litige autour d’un diagnostic assisté par IA ou d’un protocole de soin, la médiation peut être envisagée. L’IA peut aider à :

- reconstituer la chronologie des décisions ;

- expliciter le rôle de l’outil dans l’orientation du diagnostic ;

- simuler des scénarios d’amélioration de la prise en charge ou d’indemnisation.

Mais l’établissement doit respecter des exigences renforcées : information du patient, explicabilité suffisante, sécurité des données, absence d’usage caché de l’IA pour justifier un refus de prise en charge. Là encore, la médiation ne réussira que si l’IA est intégrée dans une démarche de transparence et de responsabilité, et non comme paravent.

🧾 Les modes amiables sont, par nature, des espaces où l’on mise sur l’intelligence humaine, la confiance et la recherche de solutions durables.

L’IA, si elle est utilisée avec discernement, peut devenir un formidable allié : elle aide à clarifier, à objectiver, à explorer des options que l’on n’aurait pas imaginées. Mais dès qu’elle est utilisée pour manipuler, brouiller ou masquer des informations, elle détruit les fondements mêmes de la médiation, de la conciliation ou du droit collaboratif.

Pour un entrepreneur, la clé est simple : faire de l’IA un outil au service de la négociation raisonnée (BATNA, critères objectifs, options gagnant‑gagnant) et des modes amiables, et non un instrument d’opacité. C’est à cette condition que les accords resteront solides juridiquement, acceptables humainement et durables dans le temps.

🥋 Mantra

« La négociation est un sport de combat – Il faut savoir être dur avec les questions à traiter tout en préservant les relations. »

📩 Contact

Une question ? Parlons-en, tout simplement.

Prise de rendez-vous via la page d’accueil ou par courriel : martin@lacour-avocat.fr

🎤 FAQ

1. Est-ce que j’ai le droit d’utiliser l’IA pour préparer une médiation avec un client ou un fournisseur ?

Oui, à condition que l’IA reste un outil de préparation (synthèse, scénarios, clarifications) et que vous respectiez le RGPD et la confidentialité des informations.

2. Dois-je informer l’autre partie que j’ai utilisé l’IA pour préparer la médiation ?

En modes amiables, c’est fortement recommandé : la transparence renforce la confiance, surtout si l’IA a servi à produire des scénarios d’accord.

3. Puis-je envoyer tout le dossier de médiation dans un chatbot d’IA grand public ?

Non. Vous risqueriez de violer le RGPD et la confidentialité, surtout si le service réutilise les données pour entraîner ses modèles.

4. L’IA peut-elle rédiger pour moi un protocole d’accord de médiation ?

Elle peut proposer un brouillon, mais le texte final doit être validé par un humain, idéalement par les conseils juridiques des parties.

5. Est-ce contraire à l’esprit de la médiation d’utiliser l’IA ?

Non, si l’IA est utilisée pour clarifier et structurer. Oui, si elle sert à manipuler ou à cacher des informations essentielles.

6. Puis-je utiliser l’IA pour analyser la personnalité de l’autre partie avant la médiation ?

Non, pas via un profilage caché ou une collecte de données personnelles. C’est juridiquement risqué et contraire à la loyauté.

7. Comment l’IA peut-elle m’aider en droit collaboratif ?

En préparant des résumés de pièces, en listant les points de convergence et divergence, en générant des options de solution à discuter en séance.

8. L’IA peut-elle remplacer le médiateur ou l’avocat collaboratif ?

Non. Elle peut assister, jamais remplacer. Le cœur des modes amiables, c’est la relation humaine et la gestion fine du conflit.

9. Quelles données ne jamais mettre dans une IA en contexte de médiation ?

Les données de santé, les informations intimes, les données RH sensibles, et plus largement tout ce qui est très sensible et non strictement nécessaire.

10. Comment utiliser l’IA pour respecter la négociation raisonnée en médiation ?

En lui demandant d’identifier des critères objectifs, de simuler des scénarios basés sur des données réalistes, sans jamais profiler la personne.

11. L’IA peut-elle m’aider à calculer une indemnité transactionnelle en mode amiable ?

Oui, si vous fournissez les bonnes données et vérifiez les hypothèses. Mais le montant proposé reste un point de départ, pas une vérité absolue.

12. Suis-je obligé d’inscrire l’usage de l’IA dans la convention de médiation ?

Ce n’est pas obligatoire, mais c’est une très bonne pratique pour cadrer les rôles, la confidentialité et les limites de l’IA.

13. L’IA peut-elle servir à “tester” en interne différents scénarios d’accord ?

Oui, c’est même un de ses meilleurs usages : simuler l’impact financier, opérationnel, RH de plusieurs solutions avant d’entrer en médiation.

14. Comment éviter que l’IA ne produise des accords trop standard en modes amiables ?

En la cantonnant au rôle d’assistant et en personnalisant systématiquement les projets d’accord à la situation et aux personnes.

15. Puis-je utiliser l’IA pour écrire un compte rendu de séance de médiation ?

Oui, si vous êtes très vigilant sur la confidentialité et la sécurité, et si vous ne mentionnez pas d’éléments trop sensibles.

16. L’IA peut-elle aider à mieux expliquer les enjeux à une partie non juriste ?

Oui, en reformulant les clauses en langage courant et en créant des résumés pédagogiques validés par l’humain.

17. Est-ce qu’une partie peut refuser que l’IA soit utilisée dans le processus amiable ?

Oui. Il est sain de prévoir la possibilité de refuser ou de limiter l’usage de l’IA si une partie ne s’y sent pas à l’aise.

18. Comment concilier IA, RGPD et confidentialité en médiation ?

En utilisant des outils sécurisés, idéalement hébergés dans l’UE, en minimisant les données et en informant clairement les parties.

19. L’IA peut-elle aider à identifier les intérêts réels des parties ?

Elle peut aider à structurer les informations et à faire émerger des thèmes, mais l’identification des intérêts reste un travail humain d’écoute.

20. Puis-je utiliser l’IA pour générer une “offre finale” en médiation ?

Non. Une offre finale doit être co‑construite et validée par les parties, pas imposée par un algorithme.

21. L’IA peut-elle améliorer la qualité des accords amiables ?

Oui, si elle est utilisée pour mieux anticiper les risques, clarifier les clauses et vérifier la cohérence globale de l’accord.

22. Quels sont les principaux risques à éviter avec l’IA en modes amiables ?

Le profilage caché, la manipulation des options, la diffusion de données confidentielles, et la substitution à la décision humaine.

23. Comment savoir si mon outil IA est adapté à un dossier de médiation ?

Vérifiez : sécurité, hébergement, politique RGPD, possibilité de désactiver l’apprentissage sur vos données, lisibilité des conditions d’utilisation.

24. L’IA peut-elle m’aider à éviter un procès après un échec de médiation ?

Indirectement, oui : en vous aidant à documenter vos offres, à mesurer les risques contentieux, et à préparer une stratégie claire.

25. Est-ce que les juges se méfient des accords “trop IA” ?

Ils se méfieront surtout des accords basés sur des informations incomplètes, non expliquées ou manifestement déséquilibrées, quelle que soit la technologie utilisée.

26. Comment intégrer l’IA dans la culture de mon entreprise sans dénaturer le dialogue social ?

En associant les représentants du personnel, en expliquant les cas d’usage, en formant, et en interdisant les usages intrusifs ou discriminatoires.

27. L’IA peut-elle servir en médiation interne entre équipes ?

Oui, pour analyser les flux de mails, les projets, les contraintes. Mais jamais pour “surveiller” les personnes ou noter leur comportement.

28. Dois-je faire signer quelque chose de spécial si je veux utiliser l’IA en médiation ?

Il est prudent d’ajouter des clauses spécifiques dans la convention de médiation ou les accords de confidentialité internes.

29. L’IA peut-elle générer des scénarios que je partage ensuite avec le médiateur ?

Oui, et c’est très utile, à condition que vous assumiez ces scénarios comme des propositions à discuter, pas comme des solutions imposées.

30. Quel est le meilleur réflexe pour un entrepreneur qui veut utiliser l’IA en modes amiables ?

Se dire :

“L’IA m’aide à voir plus clair, mais la confiance se construit uniquement entre humains.”

Si l’IA commence à remplacer la confiance, c’est que vous êtes allé trop loin.

⚖️ Mentions légales

Toute utilisation aux fins d’apprentissage par une IA est interdite. Tous droits réservés. Tout contrevenant s’expose à des poursuites civiles et pénales.