Le colloque organisé par l’Ordre des avocats à la Cour d’appel de Paris du 9 au 11 avril 2026 à la Maison du Barreau a consacré un panel particulièrement marquant à la question des nouvelles technologies de surveillance.

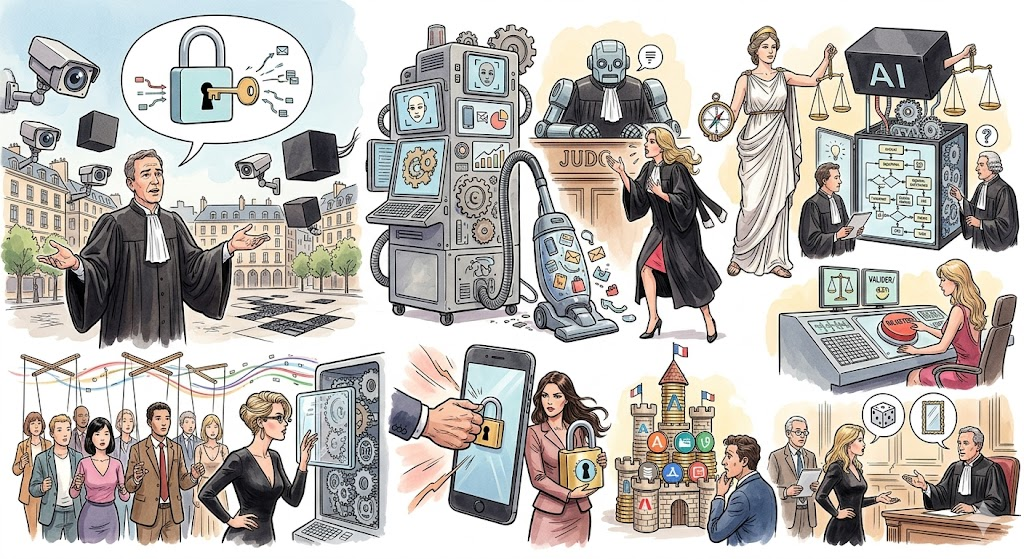

En effet, intitulé « Surveillance de masse, algorithmes et IA : la fin annoncée du libre arbitre ? », ce panel a interrogé en profondeur la manière dont l’essor de l’intelligence artificielle transforme la nature même de l’État de droit. Or l’ampleur des bouleversements en cours dépasse largement le cadre des seules questions techniques pour engager des choix de civilisation fondamentaux. Cet article propose donc une synthèse structurée des enseignements du panel, en examinant successivement les défis posés par la surveillance algorithmique (I), le dilemme structurel entre demandes étatiques de surveillance et résistances privées (II), et les voies d’une régulation démocratique adaptée (III).

I. La surveillance algorithmique : un défi inédit pour l’État de droit

A. Une mutation technologique sans précédent

1. L’opacité structurelle des algorithmes

Les intervenants du panel ont d’emblée souligné une caractéristique fondamentale des nouvelles technologies de surveillance : leur opacité structurelle. En effet, contrairement aux outils traditionnels de l’action publique, les algorithmes d’intelligence artificielle fonctionnent souvent comme des « boîtes noires » dont les logiques internes échappent à leurs propres concepteurs. Or cette opacité pose un problème démocratique majeur, car elle rend impossible le contrôle juridictionnel effectif que suppose un véritable État de droit. Ainsi, sans transparence des critères de décision, le justiciable se trouve démuni pour contester une décision algorithmique qui le concerne directement.

2. L’extension silencieuse du périmètre de surveillance

Au-delà de l’opacité, le panel a mis en lumière l’extension silencieuse du périmètre de surveillance dans nos sociétés contemporaines. En effet, la multiplication des caméras intelligentes, la reconnaissance faciale, la collecte massive de données comportementales et la traçabilité numérique transforment progressivement nos espaces publics en environnements surveillés en permanence. Or cette extension s’opère sans débat démocratique structuré, par accumulation de dispositifs techniques présentés isolément comme des solutions à des problèmes ponctuels. Mais leur agrégation produit une réalité qualitativement différente, qui appelle une réflexion politique d’ensemble actuellement absente.

3. La fin annoncée du libre arbitre ?

L’intitulé même du panel posait une question vertigineuse sur l’avenir du libre arbitre dans des sociétés saturées d’intelligence artificielle. En effet, lorsque les algorithmes anticipent nos choix, orientent nos décisions et conditionnent notre accès aux services essentiels, c’est l’autonomie individuelle elle-même qui se trouve interrogée. Or l’État de droit moderne repose précisément sur le postulat de l’autonomie du sujet capable de choix éclairés. Ainsi la question du libre arbitre n’est pas seulement philosophique : elle engage le fondement anthropologique même de notre tradition juridique.

B. Les outils de la surveillance moderne

1. La reconnaissance faciale et biométrique

Le panel a examiné en détail le développement spectaculaire des outils de reconnaissance faciale et biométrique. En effet, ces technologies permettent désormais l’identification automatique des individus dans l’espace public, transformant chaque caméra en point de contrôle potentiel. Or leur déploiement reste largement insuffisamment encadré sur le plan juridique, malgré les efforts du règlement européen sur l’intelligence artificielle. Mais leur banalisation progressive normaliserait une logique de surveillance permanente difficilement compatible avec la liberté d’aller et venir anonymement dans l’espace public.

2. La collecte massive de données comportementales

Les intervenants ont également souligné l’ampleur méconnue de la collecte massive de données comportementales par les acteurs publics et privés. En effet, chaque interaction numérique génère des traces exploitables permettant de reconstituer avec précision les habitudes, opinions et fragilités des individus. Or l’agrégation de ces données par des algorithmes prédictifs produit des profils d’une finesse inédite dans l’histoire humaine. Ainsi le RGPD européen constitue un effort important de régulation, mais son efficacité reste limitée face à la sophistication croissante des techniques de collecte.

3. Les algorithmes prédictifs dans l’action publique

Le déploiement croissant d’algorithmes prédictifs dans l’action publique constitue un troisième axe majeur d’inquiétude. En effet, ces outils sont désormais utilisés pour orienter les contrôles fiscaux, anticiper la récidive pénale, allouer les prestations sociales ou encore détecter les fraudes. Or leurs biais souvent invisibles peuvent reproduire et amplifier les discriminations sociales existantes, comme l’ont démontré plusieurs études internationales. Mais leur opacité rend particulièrement difficile la contestation juridictionnelle des décisions prises sur leur fondement, ce qui constitue une atteinte sérieuse au droit au recours effectif.

C. La perspective de la justice prédictive automatisée

1. Le risque de remplacement de l’audience

Un avocat a soulevé lors du colloque une question particulièrement préoccupante : « la prochaine étape ne serait-elle pas de remplacer l’audience par un jugement rendu par intelligence artificielle ? ». En effet, cette perspective n’est plus de la science-fiction au regard des capacités déjà développées par certaines startups de la legal tech. Or remplacer l’audience par un calcul algorithmique reviendrait à éliminer la dimension symbolique et humaine du procès, qui constitue le cœur de l’État de droit. Ainsi cette dérive doit être combattue avec la plus grande fermeté par la profession d’avocat.

2. La justice ne se réduit pas à un traitement de données

Les intervenants ont rappelé avec insistance que la justice ne se réduit jamais à un traitement de données, aussi sophistiqué soit-il. En effet, juger suppose une appréciation contextuelle, une écoute des parties et une évaluation morale qui dépassent la pure logique formelle. Or les algorithmes de justice prédictive fonctionnent par corrélation statistique sur des données passées, ce qui les rend structurellement inaptes à appréhender la singularité de chaque situation. Mais cette inadéquation fondamentale est souvent occultée par la séduction de l’efficacité apparente promise par les promoteurs de ces outils.

3. La résistance nécessaire de la profession

Face à ces dérives potentielles, la profession d’avocat doit organiser dès maintenant une résistance lucide et argumentée. En effet, la défense de l’audience comme matrice symbolique de l’État de droit constitue un combat civilisationnel majeur. Or cette défense ne peut être seulement défensive : elle doit aussi proposer une vision positive de l’utilisation des technologies au service de la justice plutôt qu’à sa place. Ainsi les outils d’aide à la décision peuvent être utiles, mais ils ne doivent jamais se substituer à la décision humaine elle-même.

II. Demandes étatiques de surveillance et résistances : un dilemme structurel

A. Une question fondamentale soulevée lors du colloque

1. L’intervention d’un avocat parisien et bruxellois

Lors d’une séance de questions du colloque, un avocat parisien et bruxellois a posé publiquement une interrogation qui mérite d’être prise au sérieux indépendamment du cas particulier qu’il évoquait. En effet, sa question portait sur la place qu’un gouvernement pratiquant la surveillance de masse de ses propres citoyens peut occuper dans un véritable État de droit. Or cette question dépasse largement tout exemple particulier pour interpeller l’ensemble des démocraties contemporaines confrontées à la tentation sécuritaire. Ainsi la formulation retenue mérite d’être reprise telle quelle : « dans un État de droit, quelle est la place d’un gouvernement qui pratique la surveillance de masse de ses citoyens ? ».

2. Une atteinte aux principes fondamentaux du droit

La surveillance de masse pose en effet un problème structurel à la philosophie même de l’État de droit contemporain. En effet, elle constitue par nature une atteinte généralisée et indifférenciée à la vie privée, contraire aux principes de proportionnalité, de nécessité et de spécialité qui structurent classiquement les ingérences étatiques admissibles. Or sa pratique systématique par un gouvernement transformerait qualitativement la nature du régime, en faisant basculer dans un autre paradigme politique sans que cette transformation soit nécessairement perçue comme telle par les citoyens. Ainsi la jurisprudence de la Cour européenne des droits de l’homme, notamment dans les arrêts Big Brother Watch c. Royaume-Uni (2021) ou Centrum för rättvisa c. Suède (2021), a posé des limites strictes aux régimes de surveillance massive admissibles dans une société démocratique.

3. Les révélations Snowden comme moment fondateur

Le débat contemporain sur la surveillance de masse a été profondément structuré par les révélations d’Edward Snowden en 2013. En effet, l’ancien consultant de la NSA a dévoilé l’ampleur des programmes de surveillance massive — PRISM, XKeyscore — déployés par les services de renseignement américains, britanniques et de leurs alliés. Or ces révélations ont conduit à plusieurs décisions juridictionnelles majeures, notamment l’invalidation par la Cour de justice de l’Union européenne de l’accord Safe Harbor en 2015 puis du Privacy Shield en 2020 dans les arrêts Schrems I et II. Ainsi le contentieux Schrems illustre la capacité du contentieux stratégique à faire évoluer en profondeur les régimes juridiques internationaux de protection des données.

B. Le dilemme structurel entre demandes étatiques et résistances privées

1. L’affaire Apple contre FBI (2016)

L’affaire Apple contre FBI de 2016 constitue l’un des cas les mieux documentés de résistance d’une entreprise technologique face à une demande étatique de surveillance. En effet, le FBI avait obtenu une ordonnance judiciaire enjoignant à Apple de créer un logiciel permettant de contourner le chiffrement de l’iPhone d’un auteur de l’attentat de San Bernardino. Or Apple a publiquement refusé d’obtempérer, plaidant que créer un tel outil constituerait une porte dérobée généralisable mettant en danger la sécurité de tous ses utilisateurs. Ainsi cette affaire emblématique illustre la tension structurelle entre impératifs de sécurité publique et préservation du chiffrement comme garantie fondamentale de la vie privée.

2. Microsoft, Signal et la défense du chiffrement

D’autres acteurs technologiques majeurs ont également opposé des résistances publiques à des demandes étatiques de surveillance. En effet, Microsoft a engagé un contentieux remonté jusqu’à la Cour suprême américaine portant sur l’extraterritorialité des demandes d’accès aux données stockées en Irlande, affaire finalement rendue sans objet par l’adoption du CLOUD Act en mars 2018 avant que la Cour ne statue au fond. Or l’application de messagerie chiffrée Signal a publiquement refusé à plusieurs reprises de modifier son architecture pour permettre des écoutes ciblées, malgré les pressions répétées des autorités américaines, britanniques et européennes. Ainsi la défense technique du chiffrement de bout en bout constitue désormais un terrain majeur de la résistance privée aux dérives de surveillance étatique.

3. Une fragilité stratégique pour les libertés démocratiques

Ces différents exemples démontrent l’existence d’un mouvement de résistance des entreprises technologiques face aux demandes étatiques excessives. En effet, certaines entreprises choisissent d’intégrer des considérations éthiques fortes dans leurs choix stratégiques, parfois contre leurs propres intérêts économiques immédiats. Or cette démarche, si elle est précieuse, révèle paradoxalement une fragilité structurelle préoccupante : faire reposer la défense des libertés démocratiques sur les choix éthiques variables d’entreprises privées, le plus souvent étrangères, constitue un pis-aller qu’aucun État de droit véritable ne peut accepter durablement. Ainsi la régulation publique démocratique demeure une nécessité absolue qui ne peut être déléguée à la seule autorégulation des acteurs privés, fût-elle vertueuse.

C. Le scandale Pegasus et les démocraties européennes

1. La révélation d’un usage massif

Le scandale Pegasus, révélé en 2021 par un consortium international de journalistes coordonné par Forbidden Stories, a démontré que la surveillance de masse n’était pas l’apanage des régimes autoritaires. En effet, le logiciel espion développé par la société israélienne NSO Group a été utilisé pour cibler des journalistes, des avocats, des opposants politiques et même des chefs d’État dans de nombreux pays, y compris des démocraties européennes. Or les enquêtes ont révélé que des États comme la Hongrie, la Pologne ou l’Espagne avaient eu recours à ce dispositif contre leurs propres citoyens engagés dans des activités démocratiques légitimes. Ainsi cette affaire confirme que la tentation de la surveillance massive traverse aujourd’hui l’ensemble des régimes politiques, y compris ceux qui se réclament de l’État de droit.

2. Le rôle décisif du contentieux européen

Face à ces dérives, la Cour européenne des droits de l’homme a progressivement développé une jurisprudence encadrant strictement les régimes de surveillance massive admissibles. En effet, dans l’arrêt Big Brother Watch c. Royaume-Uni de mai 2021, la Grande Chambre a jugé que les régimes d’interception massive doivent être soumis à un contrôle indépendant de bout en bout, depuis l’autorisation initiale jusqu’à la conservation et la destruction des données. Or cette jurisprudence pose des standards exigeants que peu de législations nationales européennes respectent intégralement aujourd’hui. Ainsi les avocats français disposent d’un corpus jurisprudentiel précieux pour contester efficacement les pratiques de surveillance qui dépasseraient les limites strictes de la nécessité démocratique.

3. La question de la dépendance numérique européenne

Au-delà de l’encadrement juridique, ces affaires posent la question fondamentale de la dépendance numérique européenne à l’égard d’acteurs étrangers. En effet, comme l’a souligné une intervenante du colloque, sa propre mise sous sanction américaine a transformé sa vie quotidienne en « laboratoire de la perte de souveraineté française et européenne », les banques françaises elles-mêmes domiciliées au niveau américain appliquant immédiatement les sanctions extraterritoriales décidées à Washington. Or cette dépendance structurelle limite considérablement la capacité européenne à protéger effectivement ses citoyens contre les surveillances étrangères, qu’elles soient publiques ou privées. Ainsi le développement d’alternatives technologiques européennes véritablement souveraines constitue désormais une condition essentielle de la préservation de l’État de droit en Europe, au-delà des seules régulations juridiques.

III. Vers une régulation démocratique de l’intelligence artificielle

A. Les avancées européennes récentes

1. Le règlement européen sur l’intelligence artificielle

L’Union européenne a adopté en 2024 son règlement historique sur l’intelligence artificielle, premier cadre juridique global au monde. En effet, ce texte établit une classification des usages de l’IA selon leur niveau de risque, avec des obligations renforcées pour les usages les plus sensibles. Or il interdit notamment certaines pratiques comme la notation sociale ou la reconnaissance faciale en temps réel dans l’espace public sauf exceptions strictement encadrées. Ainsi l’Europe affirme sa volonté de proposer un modèle alternatif au laisser-faire américain et au contrôle étatique chinois.

2. Les limites du dispositif actuel

Malgré ses avancées, le règlement européen présente plusieurs limites qu’il importe d’identifier honnêtement. En effet, son entrée en application progressive, ses nombreuses exceptions sécuritaires et la difficulté pratique de contrôler les acteurs non européens en limitent l’efficacité. Or les rapports de force économiques internationaux pèsent lourdement sur l’application réelle du texte. Mais ces limites ne disqualifient pas l’effort européen : elles appellent au contraire son renforcement progressif et son extension à d’autres juridictions partenaires.

3. La nécessaire articulation avec la CEDH

Le cadre européen doit également s’articuler avec la jurisprudence de la Cour européenne des droits de l’homme. En effet, plusieurs droits garantis par la Convention — vie privée, recours effectif, non-discrimination — sont directement engagés par les usages contemporains de l’IA. Or la Cour a commencé à développer une jurisprudence en matière de surveillance algorithmique qui mérite d’être approfondie. Ainsi les avocats français peuvent désormais s’appuyer sur ces deux corpus juridiques complémentaires pour défendre efficacement les justiciables face aux décisions algorithmiques.

B. Les conditions d’une régulation démocratique efficace

1. Transparence et explicabilité des algorithmes

La première condition d’une régulation démocratique efficace tient à l’exigence de transparence et d’explicabilité des algorithmes. En effet, sans accès aux logiques internes des systèmes d’IA, le contrôle juridictionnel devient impossible et le droit au recours effectif se trouve vidé de sa substance. Or l’opposition fréquente du « secret des affaires » à cette transparence ne saurait prévaloir lorsque sont en jeu les droits fondamentaux des justiciables. Ainsi la profession d’avocat doit plaider activement pour l’extension de l’obligation d’explicabilité à tous les algorithmes affectant les droits des personnes.

2. Contrôle humain effectif sur les décisions importantes

La deuxième condition tient au maintien d’un contrôle humain effectif sur les décisions importantes affectant les personnes. En effet, le RGPD pose déjà le principe selon lequel aucune décision purement automatisée ne peut produire d’effets juridiques significatifs sur une personne. Or ce principe doit être étendu, renforcé et effectivement appliqué à l’ensemble des décisions algorithmiques concernant les justiciables. Mais ce contrôle humain ne doit pas se réduire à une validation formelle qui se contenterait d’entériner mécaniquement la décision algorithmique.

3. Recours juridictionnel renforcé

La troisième condition tient au renforcement des voies de recours juridictionnel contre les décisions algorithmiques. En effet, les justiciables doivent pouvoir contester efficacement non seulement le résultat d’une décision automatisée mais aussi les critères et logiques qui l’ont produite. Or cette possibilité suppose des aménagements procéduraux spécifiques, notamment en matière de charge de la preuve et d’expertise technique. Ainsi le développement d’une véritable expertise juridictionnelle en matière algorithmique constitue un chantier prioritaire des années à venir.

C. Le rôle pivotal des avocats dans la défense numérique

1. Se former aux enjeux techniques

Les avocats français doivent d’urgence se former aux enjeux techniques de l’intelligence artificielle pour exercer efficacement leur mission de défense. En effet, comprendre comment fonctionne un algorithme, identifier ses biais possibles, contester ses résultats supposent des compétences techniques nouvelles encore largement absentes de la formation initiale. Or cette montée en compétence ne peut être laissée à l’initiative individuelle : elle doit être organisée collectivement par les barreaux et les écoles de formation. Ainsi la création de spécialisations en droit du numérique et en intelligence artificielle constitue une priorité stratégique.

2. Construire des contentieux stratégiques

Au-delà de la formation, les avocats doivent construire activement des contentieux stratégiques permettant de faire évoluer la jurisprudence. En effet, c’est par l’accumulation de décisions juridictionnelles que se construit progressivement un véritable droit de l’intelligence artificielle. Or ces contentieux supposent une coordination entre confrères, un partage des bonnes pratiques et une mobilisation de ressources expertes coûteuses. Ainsi la solidarité confraternelle organisée par les barreaux constitue un levier essentiel de cette construction jurisprudentielle.

3. Alerter le débat public

Enfin, les avocats ont une responsabilité particulière dans l’alerte du débat public sur les enjeux numériques. En effet, leur expérience de terrain leur confère une légitimité particulière pour traduire les enjeux techniques en termes accessibles aux citoyens. Or cette pédagogie publique est indispensable pour que les choix de société en matière de régulation de l’IA puissent être effectivement débattus démocratiquement. Ainsi la profession doit s’investir massivement dans l’écriture publique, les interventions médiatiques et la formation citoyenne sur ces enjeux.

IV. Pour un diagnostic nuancé : les angles morts de la critique

A. Le risque d’une technophobie indifférenciée

La critique des outils algorithmiques pourrait, si elle n’est pas finement calibrée, verser dans une technophobie indifférenciée contre-productive pour le débat démocratique. En effet, dénoncer en bloc « les algorithmes » sans distinguer leurs usages risquerait de disqualifier des outils par ailleurs utiles : aide à la décision, désengorgement administratif, détection de fraudes massives bénéficiant aux finances publiques. Or l’opposition « humain pur contre algorithme pur » constitue largement un faux dilemme, car la plupart des dispositifs contemporains combinent intervention humaine et traitement automatisé. Ainsi la profession gagnerait à développer une expertise fine permettant de distinguer les usages problématiques des usages bénéfiques, plutôt qu’à opposer un refus global qui pourrait apparaître réactionnaire.

B. L’angle mort des biais humains comparés

La critique des biais algorithmiques omet souvent de comparer ces biais à ceux, largement documentés, de la décision humaine elle-même. En effet, la magistrature humaine présente des biais cognitifs établis par la recherche : effets d’ancrage, fatigue décisionnelle variant selon l’heure de la journée, disparités sociologiques inconscientes, écarts mesurables selon les juridictions et les magistrats. Or comparer un algorithme imparfait à un juge idéalement neutre fausse fondamentalement la comparaison nécessaire à un débat démocratique éclairé. Ainsi la vraie question pourrait être moins « algorithme ou humain ? » que « quel système combiné produit le moins de discriminations mesurables et d’erreurs documentées ? », ce qui suppose une évaluation rigoureuse encore largement à conduire.

C. L’angle mort de la souveraineté éthique privée

Les résistances privées de certaines entreprises technologiques face aux demandes étatiques excessives, examinées en partie II, méritent d’être resituées dans une réflexion plus large sur leurs limites stratégiques. En effet, se reposer sur l’éthique d’entreprises privées le plus souvent étrangères pour défendre les libertés européennes constitue une fragilité stratégique majeure que la profession ne saurait ignorer. Or saluer telle ou telle décision vertueuse ponctuelle ne dispense nullement d’interroger la dépendance structurelle qui rend ce salut nécessaire dans nos économies européennes. Ainsi l’enjeu réel ne tient pas tant à la qualité éthique conjoncturelle de tel ou tel acteur — variable et révisable à tout moment selon les changements de direction ou les pressions actionnariales — qu’à la construction d’alternatives technologiques européennes véritablement souveraines, condition d’une régulation démocratique effective et durable.

Le panel du colloque sur la surveillance de masse, les algorithmes et l’IA aura livré un diagnostic à la fois lucide et préoccupant sur les défis posés à l’État de droit par les nouvelles technologies.

En effet, l’opacité structurelle des algorithmes, l’extension silencieuse de la surveillance et la perspective d’une justice prédictive automatisée constituent autant de menaces inédites pour notre tradition juridique. Or les affaires emblématiques évoquées — révélations Snowden, Apple contre FBI, scandale Pegasus — illustrent concrètement la gravité des enjeux et l’importance de résister fermement à toute dérive vers la surveillance de masse, tout en interrogeant la fragilité d’une défense des libertés reposant en partie sur les choix éthiques d’entreprises privées étrangères. Ainsi la défense de l’État de droit numérique exige une mobilisation urgente de la profession d’avocat, à travers la formation, les contentieux stratégiques et l’alerte du débat public. C’est à cette condition seulement que le libre arbitre, fondement anthropologique de notre droit, pourra survivre à la révolution algorithmique en cours.

FAQ

1. Qu’est-ce que la surveillance de masse algorithmique ?

La surveillance de masse algorithmique désigne la collecte généralisée et indifférenciée de données sur l’ensemble d’une population, traitées par des algorithmes pour identifier des comportements, anticiper des actions ou cibler des individus. Elle se distingue de la surveillance ciblée traditionnelle par son caractère systématique et son ampleur inédite, rendue possible par les capacités contemporaines de stockage et de traitement de données.

2. Qu’est-ce que l’affaire Apple contre FBI de 2016 ?

L’affaire Apple contre FBI est l’un des cas emblématiques de résistance d’une entreprise technologique face à une demande étatique de surveillance. Le FBI avait obtenu en 2016 une ordonnance judiciaire enjoignant à Apple de créer un logiciel permettant de contourner le chiffrement de l’iPhone d’un auteur de l’attentat de San Bernardino. Apple a publiquement refusé d’obtempérer, plaidant que créer un tel outil constituerait une porte dérobée généralisable mettant en danger la sécurité de tous ses utilisateurs. Cette affaire illustre la tension structurelle entre impératifs de sécurité publique et préservation du chiffrement comme garantie fondamentale de la vie privée.

3. Pourquoi l’opacité des algorithmes pose-t-elle un problème démocratique ?

L’opacité des algorithmes pose un problème démocratique majeur car elle rend impossible le contrôle juridictionnel effectif que suppose un véritable État de droit. Sans accès aux critères de décision et aux logiques internes des systèmes d’IA, le justiciable se trouve démuni pour contester une décision algorithmique qui le concerne. Le droit au recours effectif garanti par l’article 13 de la CEDH se trouve ainsi vidé de sa substance.

4. Que dit le règlement européen sur l’intelligence artificielle de 2024 ?

Le règlement européen sur l’IA, premier cadre juridique global au monde, établit une classification des usages selon leur niveau de risque avec des obligations renforcées pour les plus sensibles. Il interdit notamment certaines pratiques comme la notation sociale ou la reconnaissance faciale en temps réel dans l’espace public, sauf exceptions strictement encadrées. Son application progressive a commencé en 2025 et se poursuit jusqu’en 2027.

5. Qu’est-ce que la justice prédictive automatisée ?

La justice prédictive automatisée désigne le projet de remplacer ou d’assister fortement les décisions juridictionnelles humaines par des algorithmes calculant statistiquement la solution probable d’un litige à partir de données passées. Cette perspective, déjà partiellement déployée par certaines startups de la legal tech, soulève des questions fondamentales sur la nature même de la fonction juridictionnelle et sur la place du justiciable dans le procès.

6. Qu’est-ce que la souveraineté numérique européenne ?

La souveraineté numérique européenne désigne la capacité de l’Union européenne et de ses États membres à maîtriser leurs propres infrastructures, données et technologies numériques sans dépendance excessive à l’égard d’acteurs extra-européens. Elle conditionne directement la préservation de l’État de droit, comme l’illustre l’application immédiate des sanctions américaines extraterritoriales par les banques françaises elles-mêmes domiciliées au niveau américain.

7. Comment les algorithmes peuvent-ils reproduire les discriminations sociales ?

Les algorithmes prédictifs sont entraînés sur des données historiques qui reflètent souvent les discriminations sociales préexistantes. Lorsqu’ils sont déployés dans l’action publique pour orienter les contrôles fiscaux, anticiper la récidive ou allouer les prestations sociales, ils reproduisent et amplifient ces biais discriminatoires. Leur opacité rend particulièrement difficile l’identification et la contestation de ces effets discriminatoires sur les justiciables.

8. Quel rôle joue le RGPD dans la protection contre la surveillance algorithmique ?

Le RGPD européen pose le principe selon lequel aucune décision purement automatisée ne peut produire d’effets juridiques significatifs sur une personne sans intervention humaine effective. Il consacre également les droits d’accès, de rectification et d’opposition des personnes concernées par le traitement de leurs données. Mais son efficacité reste limitée face à la sophistication croissante des techniques de collecte et d’analyse contemporaines.

9. Pourquoi l’audience est-elle irremplaçable dans le procès ?

L’audience constitue la matrice symbolique de l’État de droit en permettant l’expression contradictoire publique des arguments, l’incarnation humaine de la justice et l’appréciation contextuelle de la singularité de chaque situation. Aucun algorithme, aussi sophistiqué soit-il, ne peut remplacer cette dimension humaine fondamentale qui distingue le jugement véritable du simple traitement de données.

10. Comment les avocats français peuvent-ils se former à l’intelligence artificielle ?

Les avocats peuvent se former à l’IA via les diplômes universitaires spécialisés en droit du numérique, les formations continues dispensées par les barreaux et les écoles d’avocats, ou les certifications proposées par des organismes spécialisés. Plusieurs masters en droit et intelligence artificielle se sont récemment développés dans les universités françaises. Cette montée en compétence constitue désormais une priorité stratégique pour la profession.

11. Qu’est-ce que l’extraterritorialité numérique américaine ?

L’extraterritorialité numérique américaine désigne la capacité des États-Unis à imposer leurs décisions — sanctions, mesures de surveillance, obligations de coopération — au-delà de leurs frontières nationales, en s’appuyant sur la position dominante de leurs acteurs technologiques mondiaux. Cette extraterritorialité affecte directement les citoyens européens, comme l’illustre l’application immédiate des sanctions américaines par les banques européennes elles-mêmes.

12. Quels sont les risques de la reconnaissance faciale dans l’espace public ?

La reconnaissance faciale dans l’espace public permet l’identification automatique de chaque individu, transformant chaque caméra en point de contrôle potentiel et menaçant la liberté d’aller et venir anonymement. Elle pourrait progressivement normaliser une logique de surveillance permanente difficilement compatible avec une société libre. Le règlement européen sur l’IA en interdit largement l’usage en temps réel sauf exceptions strictement encadrées.

13. Comment contester une décision administrative algorithmique en France ?

Une décision administrative algorithmique peut être contestée devant le juge administratif sur le fondement du droit à l’information sur le traitement automatisé, de l’obligation de motivation et du droit au recours effectif. Le justiciable peut demander l’explicitation des règles algorithmiques utilisées et contester leur conformité au droit. La jurisprudence en la matière reste néanmoins encore en construction.

14. Quel rôle joue la Cour européenne des droits de l’homme face à la surveillance algorithmique ?

La CEDH a commencé à développer une jurisprudence importante en matière de surveillance algorithmique sur le fondement des articles 8 (vie privée), 13 (recours effectif) et 14 (non-discrimination) de la Convention. Plusieurs arrêts récents ont notamment encadré strictement les pratiques de surveillance étatique et imposé des garanties procédurales renforcées. Ce corpus jurisprudentiel constitue un appui précieux pour les avocats français.

15. Comment concilier innovation technologique et protection des libertés ?

La conciliation entre innovation technologique et protection des libertés suppose une régulation démocratique adaptée reposant sur trois piliers : transparence et explicabilité des algorithmes, contrôle humain effectif sur les décisions importantes, et renforcement des voies de recours juridictionnel. Elle suppose également une formation massive des juristes aux enjeux techniques et un débat public éclairé sur les choix de société en matière d’intelligence artificielle.

16. Qu’est-ce que le scandale Pegasus et pourquoi concerne-t-il les démocraties européennes ?

Le scandale Pegasus, révélé en juillet 2021 par le consortium Forbidden Stories, a démontré que le logiciel espion développé par la société israélienne NSO Group avait été utilisé pour cibler des journalistes, des avocats, des opposants politiques et même des chefs d’État dans de nombreux pays, y compris des démocraties européennes comme la Hongrie, la Pologne et l’Espagne. Cette affaire a prouvé que la tentation de la surveillance massive traverse l’ensemble des régimes politiques sans exception.

17. Qu’est-ce que le CLOUD Act américain de 2018 et quelles sont ses implications pour l’Europe ?

Le CLOUD Act (Clarifying Lawful Overseas Use of Data Act) adopté en mars 2018 permet aux autorités américaines de demander aux entreprises technologiques américaines l’accès aux données de leurs utilisateurs, y compris lorsque ces données sont stockées sur des serveurs situés hors des États-Unis. Cette loi a des implications majeures pour les citoyens et entreprises européens dont les données sont hébergées par des acteurs américains. Elle illustre l’extraterritorialité de la législation américaine en matière numérique.

18. Que sont les arrêts Schrems I et Schrems II de la Cour de justice de l’Union européenne ?

Les arrêts Schrems I (2015) et Schrems II (2020) rendus par la CJUE ont invalidé successivement le Safe Harbor puis le Privacy Shield, deux accords encadrant le transfert de données personnelles entre l’Union européenne et les États-Unis. Ces décisions historiques ont été rendues à l’initiative de l’activiste autrichien Max Schrems qui a démontré que le cadre juridique américain ne garantissait pas une protection suffisante des données européennes face aux programmes de surveillance de la NSA.

19. Qu’est-ce que le chiffrement de bout en bout et pourquoi est-il essentiel aux libertés ?

Le chiffrement de bout en bout est une technique de communication numérique qui garantit que seuls l’expéditeur et le destinataire peuvent lire le contenu des messages échangés, aucun tiers — y compris le fournisseur du service — ne pouvant y accéder. Il constitue un rempart fondamental pour la vie privée, la confidentialité des échanges avocat-client et la protection des sources journalistiques. Les pressions étatiques pour affaiblir le chiffrement sous prétexte sécuritaire constitueraient une menace directe sur ces libertés fondamentales.

20. Comment la CEDH encadre-t-elle les régimes de surveillance massive des communications ?

La Cour européenne des droits de l’homme a développé depuis l’arrêt Klass c. Allemagne (1978) une jurisprudence encadrant strictement les régimes de surveillance massive au regard de l’article 8 de la Convention garantissant le droit à la vie privée. L’arrêt Big Brother Watch c. Royaume-Uni (2021) a précisé que ces régimes doivent être soumis à un contrôle indépendant de bout en bout couvrant l’autorisation initiale, la sélection des données, le stockage et la destruction. Peu de législations nationales européennes respectent intégralement ces standards exigeants.

21. Qu’est-ce que la reconnaissance faciale en temps réel et pourquoi le règlement européen l’interdit-il ?

La reconnaissance faciale en temps réel est une technologie biométrique permettant l’identification automatique des individus dans l’espace public à partir de caméras de vidéosurveillance connectées à des bases de données. Le règlement européen sur l’IA de 2024 l’interdit en principe dans les espaces publics car elle constitue une atteinte disproportionnée à la liberté d’aller et venir anonymement. Des exceptions strictement encadrées sont prévues pour les situations de menace terroriste imminente ou de recherche de victimes d’enlèvement.

22. Qu’est-ce qu’un algorithme prédictif dans le domaine judiciaire et pourquoi pose-t-il problème ?

Un algorithme prédictif judiciaire est un outil informatique qui calcule statistiquement la probabilité d’un résultat juridictionnel — condamnation, récidive, montant d’une indemnisation — en se fondant sur des corrélations tirées de décisions passées. Il pose problème car il fonctionne par corrélation et non par compréhension de la singularité de chaque situation humaine, reproduisant ainsi mécaniquement les biais et discriminations présents dans les données historiques. La justice suppose une appréciation contextuelle et morale qu’aucun algorithme ne peut remplacer.

23. Comment un justiciable peut-il contester une décision administrative automatisée en droit français ?

Un justiciable peut contester une décision administrative automatisée en France en s’appuyant sur le droit à l’information sur le traitement automatisé consacré par le RGPD, l’obligation de motivation des décisions administratives et le droit au recours effectif garanti par la CEDH. Il peut demander l’explicitation des règles algorithmiques utilisées et contester leur conformité au droit devant le juge administratif. La jurisprudence en la matière reste cependant encore en construction et suppose souvent une expertise technique coûteuse.

24. Comment fonctionne le Digital Services Act européen en matière de régulation des plateformes ?

Le Digital Services Act européen, règlement de 2022 pleinement applicable depuis 2024, impose aux grandes plateformes numériques des obligations renforcées en matière de transparence des algorithmes de recommandation, de modération des contenus illicites et de gestion des risques systémiques. Il prévoit des sanctions pouvant atteindre 6 % du chiffre d’affaires mondial en cas de manquement. Ce texte constitue l’un des piliers de l’approche européenne de régulation de l’espace numérique.

25. Quelle est la différence entre surveillance ciblée et surveillance de masse en droit européen ?

La surveillance ciblée vise un individu spécifique sur la base d’une suspicion individualisée, autorisée au cas par cas par une autorité indépendante et soumise à des garanties procédurales strictes. La surveillance de masse intercepte au contraire de manière indifférenciée l’ensemble des communications d’une population ou d’un canal, sans suspicion préalable. La CEDH admet la seconde sous conditions extrêmement restrictives, exigeant notamment un contrôle indépendant à toutes les étapes du processus.

26. Pourquoi la souveraineté numérique européenne est-elle une condition de l’État de droit ?

La souveraineté numérique européenne conditionne l’État de droit car la dépendance à l’égard d’infrastructures et services numériques contrôlés par des acteurs extra-européens expose les citoyens et institutions européens à des décisions unilatérales échappant à tout contrôle démocratique. Les sanctions américaines extraterritoriales illustrent concrètement cette vulnérabilité lorsque même les banques françaises appliquent immédiatement des décisions prises à Washington. Le développement d’alternatives technologiques européennes constitue donc un chantier stratégique de premier plan.

27. Comment les lanceurs d’alerte contribuent-ils à la régulation de la surveillance numérique ?

Les lanceurs d’alerte jouent un rôle décisif dans la régulation de la surveillance numérique en révélant les pratiques illicites ou disproportionnées des États et des entreprises technologiques. Edward Snowden en 2013 sur les programmes de la NSA et les sources de Forbidden Stories en 2021 sur Pegasus ont profondément transformé le cadre juridique international de la protection des données. Leur protection juridique effective constitue une condition essentielle de la transparence démocratique en matière de surveillance.

28. Quels sont les risques d’une approche purement technophobe face à l’intelligence artificielle ?

Une approche purement technophobe face à l’intelligence artificielle risquerait de disqualifier des outils par ailleurs utiles pour le service public, la justice et les justiciables eux-mêmes. Les outils d’aide à la décision, de détection de fraudes massives ou de désengorgement administratif peuvent apporter des bénéfices réels lorsqu’ils sont correctement encadrés et supervisés. La vraie question consiste à distinguer finement les usages problématiques des usages bénéfiques plutôt qu’à opposer un refus global au progrès technologique.

29. Comment comparer objectivement les biais algorithmiques et les biais humains en matière judiciaire ?

La comparaison objective suppose de mesurer empiriquement les biais des deux systèmes selon les mêmes critères : disparités de traitement selon l’origine, le sexe ou la situation sociale, effets d’ancrage, cohérence des décisions dans le temps et entre juridictions. Les biais humains sont largement documentés mais rarement quantifiés systématiquement. Une évaluation rigoureuse supposerait donc de développer des protocoles de recherche comparatifs associant juristes, statisticiens et spécialistes de l’intelligence artificielle.

30. Quelles compétences techniques un avocat doit-il acquérir pour défendre efficacement ses clients face aux décisions algorithmiques ?

Un avocat confronté aux décisions algorithmiques devrait acquérir des compétences minimales en science des données, en fonctionnement des algorithmes de machine learning, en détection des biais statistiques et en analyse critique des résultats produits par les systèmes automatisés. Ces compétences peuvent être développées à travers des formations continues spécialisées proposées par les barreaux et les universités. Elles permettent de construire des contestations juridiquement et techniquement fondées plutôt que de s’en remettre uniquement à des experts extérieurs.